-

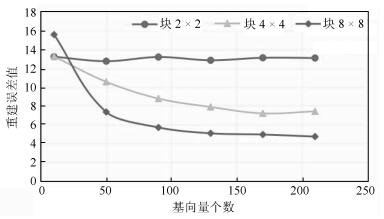

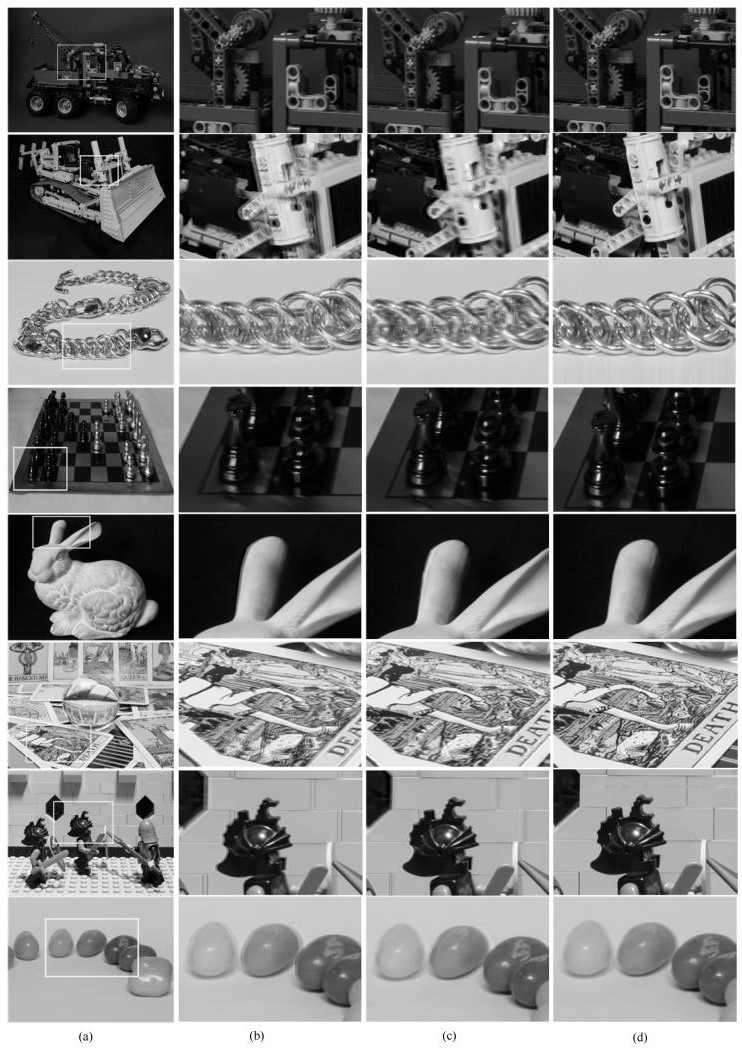

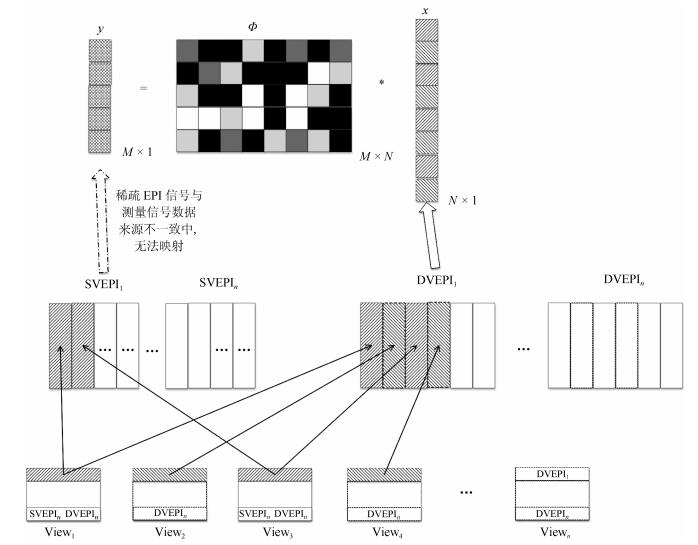

摘要: 为了减少所需采集的视频数据量, 基于图像绘制(Image-based rendering, IBR) 的前沿方法将稠密视点信息映射成压缩感知框架中的原始信号, 并将稀疏视点图像作为随机测量值, 但低维测量信号由所有稠密视点信息线性组合而成, 而稀疏视点图像仅仅来源于部分视点信息, 导致稀疏视点采集的图像与低维测量信号不一致. 本文提出利用间隔采样矩阵消除测量信号与稀疏视点图像位置之间的差异, 进而通过约束由测量矩阵和基函数构成的传感矩阵尽量满足有限等距性, 使得能够获得原始信号的唯一精确解. 仿真实验结果表明, 相比于前沿方法, 本文提出的方法对于不同复杂程度的场景重建都提高了主客观质量.Abstract: In order to reduce the amount of video data that needs to be acquired greatly, state-of-the-art of the image-based rendering (IBR) method maps the dense viewpoint information into the original signal in the compressed sensing frame and utilizes sparse viewpoint images as random measurement information. However, the low-dimensional measurement signals are linearly combined using all of the dense viewpoint information, and the sparse viewpoint images only originate from partial viewpoint information, which results in the images acquired by the sparse viewpoints are inconsistent with the low-dimensional measurement signal. A sparse viewpoint measurement matrix is proposed, and an interval sampling matrix is used to align the sampling positions between the measured values and sparse viewpoint image information. Then, we constrain the sensing matrix, which consists of the measurement matrix and basis function, to satisfy the restricted isometry property as much as possible. Finally, the unique solution of the original signal can be obtained. The simulation results show that compared with conventional methods, the proposed method improves the subjective and objective quality for scene reconstruction with difierent levels of complexity.

-

Key words:

- Multi-view image reconstruction /

- image-based rendering (IBR) /

- epipolar plane image /

- compression perception

-

肺癌是世界范围内发病率和死亡率最高的疾病之一, 占所有癌症病发症的18 %左右[1].美国癌症社区统计显示, 80 %到85 %的肺癌为非小细胞肺癌[2].在该亚型中, 大多数病人会发生淋巴结转移, 在手术中需对转移的淋巴结进行清扫, 现阶段通常以穿刺活检的方式确定淋巴结的转移情况.因此, 以非侵入性的方式确定淋巴结的转移情况对临床治疗具有一定的指导意义[3-5].然而, 基本的诊断方法在无创淋巴结转移的预测上存在很大挑战.

影像组学是针对医学影像的兴起的热门方法, 指通过定量医学影像来描述肿瘤的异质性, 构造大量纹理图像特征, 对临床问题进行分析决策[6-7].利用先进机器学习方法实现的影像组学已经大大提高了肿瘤良恶性的预测准确性[8].研究表明, 通过客观定量的描述影像信息, 并结合临床经验, 对肿瘤进行术前预测及预后分析, 将对临床产生更好的指导价值[9].

本文采用影像组学的方法来解决非小细胞肺癌淋巴结转移预测的问题.通过利用套索逻辑斯特回归(Lasso logistics regression, LLR)[10]模型得出基本的非小细胞肺癌淋巴结的转移预测概率, 并把组学模型的预测概率作为独立的生物标志物, 与患者的临床特征一起构建多元Logistics预测模型并绘制个性化诺模图, 在临床决策中的起重要参考作用.

1. 材料和方法

1.1 病人数据

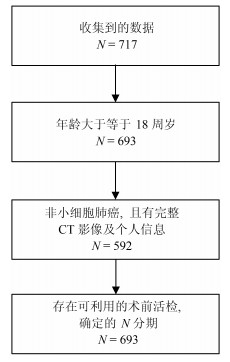

我们收集了广东省人民医院2007年5月至2014年6月期间的717例肺癌病例.这些病人在签署知情同意书后, 自愿提供自己的信息作为研究使用.为了充分利用收集到的数据对非小细胞肺癌淋巴结转移预测, 即对$N1-N3$与$N0$进行有效区分, 我们对收集的数据设置了三个入组标准: 1)年龄大于等于18周岁, 此时的肺部已经发育完全, 消除一定的干扰因素; 2)病理诊断为非小细胞肺癌无其他疾病干扰, 并有完整的CT (Computed tomography)增强图像及个人基本信息; 3)有可利用的术前病理组织活检分级用于确定N分期.经筛选, 共564例病例符合进行肺癌淋巴结转移预测研究的要求(如图 1).

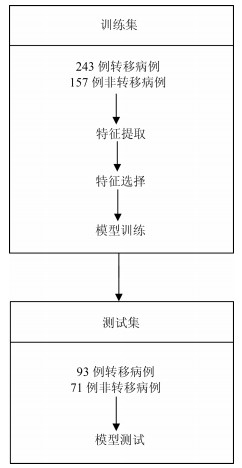

为了得到有价值的结果, 考虑到数据的分配问题, 为了保证客观性, 防止挑数据的现象出现, 在数据分配上, 训练集与测试集将按照时间进行划分, 并以2013年1月为划分点.得到训练集: 400例, 其中, 243例正样本$N1-N3$, 157例负样本$N0$; 测试集: 164例, 其中, 93例正样本, 71例负样本.

1.2 病灶分割

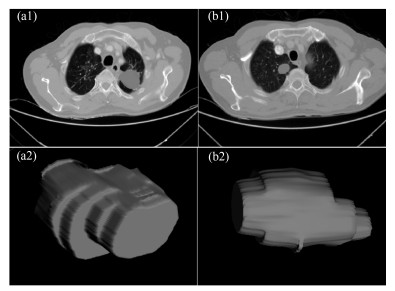

在进行特征提取工作前, 首先要对肿瘤病灶进行分割.医学图像分割的金标准是需要有经验的医生进行手动勾画的结果.但手动分割无法保证每次的分割结果完全一致, 且耗时耗力, 尤其是在数据量很大的情况下.因此, 手动分割不是最理想的做法.在本文中, 使用的自动图像分割算法为基于雪橇的自动区域生长分割算法[11], 该算法首先选定最大切片层的种子点, 这时一般情况下最大切片为中间层的切片, 然后估计肿瘤的大小即直径, 作为一个输入参数, 再自动进行区域生长得到每个切片的肿瘤如图 2(a1), (b1), 之后我们进行雪橇滑动到邻接的上下两个切面, 进行分割, 这样重复上述的区域生长即滑动切片, 最终分割得到多个切片的的肿瘤区域, 我们将肿瘤切面层进行组合, 得到三维肿瘤如图 2(a2), (b2).

1.3 特征的提取与筛选

利用影像组学处理方法, 从分割得到的肿瘤区域中总共提取出386个特征.这些特征可分为四组:三维形状特征, 表面纹理特征, Gabor特征和小波特征[12-13].形状特征通过肿瘤体积、表面积、体积面积比等特征描述肿瘤在空间和平面上的信息.纹理特征通过统计三维不同方向上像素的规律, 通过不同的分布规律来表示肿瘤的异质性. Gabor特征指根据特定方向, 特定尺度筛选出来的纹理信息.

小波特征是指原图像经过小波变换滤波器后的纹理特征.在模式识别范畴中, 高维特征会增加计算复杂度, 此外, 高维的特征往往存在冗余性, 容易造成模型过拟合.因此, 本位通过特征筛选方法首先对所有特征进行降维处理.

本文采用$L$1正则化Lasso进行特征筛选, 对于简单线性回归模型定义为:

$$ \begin{equation} f(x)=\sum\limits_{j=1}^p {w^jx^j} =w^\mathrm{T}x \end{equation} $$ (1) 其中, $x$表示样本, $w$表示要拟合的参数, $p$表示特征的维数.

要进行参数$w$学习, 应用二次损失来表示目标函数, 即:

$$ \begin{equation} J(w)=\frac{1}{n}\sum\limits_{i=1}^n{(y_i-f(x_i)})^2= \frac{1}{n}\vert\vert\ {{y}-Xw\vert\vert}^2 \end{equation} $$ (2) 其中, $X$是数据矩阵, $X=(x_1 , \cdots, x_n)^\mathrm{T}\in {\bf R}^{n\times p}$, ${y}$是由标签组成的列向量, ${y}=(y_1, \cdots, y_n )^\mathrm{T}$.

式(2)的解析解为:

$$ \begin{equation} \hat{w}=(X^\mathrm{T}X)^{-1}X^\mathrm{T}{y} \end{equation} $$ (3) 然而, 若$p\gg n$, 即特征维数远远大于数据个数, 矩阵$X^\mathrm{T}X$将不是满秩的, 此时无解.

通过Lasso正则化, 得到目标函数:

$$ \begin{equation} J_L(w)=\frac{1}{n} \vert\vert{y}-Xw\vert\vert^2+\lambda\vert\vert w\vert\vert _1 \end{equation} $$ (4) 目标函数最小化等价为:

$$ \begin{equation} \mathop {\min }\limits_w \frac{1}{n} \vert\vert{y}-Xw\vert\vert^2, \, \, \, \, \, \, \, \mathrm{s.t.}\, \, \vert \vert w\vert \vert _1 \le C \end{equation} $$ (5) 为了使部分特征排除, 本文采用$L$1正则方法进行压缩.二维情况下, 在$\mbox{(}w^1, w^2)$平面上可画出目标函数的等高线, 取值范围则为平面上半径为$C$的$L$1范数圆, 等高线与$L$1范数圆的交点为最优解. $L$1范数圆和每个坐标轴相交的地方都有"角''出现, 因此在角的位置将产生稀疏性.而在维数更高的情况下, 等高线与L1范数球的交点除角点之外还可能产生在很多边的轮廓线上, 同样也会产生稀疏性.对于式(5), 本位采用近似梯度下降(Proximal gradient descent)[14]算法进行参数$w$的迭代求解, 所构造的最小化函数为$Jl=\{g(w)+R(w)\}$.在每次迭代中, $Jl(w)$的近似计算方法如下:

$$ \begin{align} J_L (w^t+d)&\approx \tilde {J}_{w^t} (d)=g(w^t)+\nabla g(w^t)^\mathrm{T}d\, +\nonumber\\ &\frac{1} {2d^\mathrm{T}(\frac{I }{ \alpha })d}+R(w^t+d)=\nonumber\\ &g(w^t)+\nabla g(w^t)^\mathrm{T}d+\frac{{d^\mathrm{T}d} } {2\alpha } +\nonumber\\ &R(w^t+d) \end{align} $$ (6) 更新迭代$w^{(t+1)}\leftarrow w^t+\mathrm{argmin}_d \tilde {J}_{(w^t)} (d)$, 由于$R(w)$整体不可导, 因而利用子可导引理得:

$$ \begin{align} w^{(t+1)}&=w^t+\mathop {\mathrm{argmin}} \nabla g(w^t)d^\mathrm{T}d\, +\nonumber\\ &\frac{d^\mathrm{T}d}{2\alpha }+\lambda \vert \vert w^t+d\vert \vert _1=\nonumber\\ &\mathrm{argmin}\frac{1 }{ 2}\vert \vert u-(w^t-\alpha \nabla g(w^t))\vert \vert ^2+\nonumber\\ &\lambda \alpha \vert \vert u\vert \vert _1 \end{align} $$ (7) 其中, $S$是软阈值算子, 定义如下:

$$ \begin{equation} S(a, z)=\left\{\begin{array}{ll} a-z, &a>z \\ a+z, &a<-z \\ 0, &a\in [-z, z] \\ \end{array}\right. \end{equation} $$ (8) 整个迭代求解过程为:

输入.数据$X\in {\bf R}^{n\times p}, {y}\in {\bf R}^n$, 初始化$w^{(0)}$.

输出.参数$w^\ast ={\rm argmin}_w\textstyle{1 \over n}\vert \vert Xw-{y}\vert \vert ^2+\\ \lambda \vert\vert w\vert \vert _1 $.

1) 初始化循环次数$t = 0$;

2) 计算梯度$\nabla g=X^\mathrm{T}(Xw-{y})$;

3) 选择一个步长大小$\alpha ^t$;

4) 更新$w\leftarrow S(w-\alpha ^tg, \alpha ^t\lambda )$;

5) 判断是否收敛或者达到最大迭代次数, 未收敛$t\leftarrow t+1$, 并循环2)$\sim$5)步.

通过上述迭代计算, 最终得到最优参数, 而参数大小位于软区间中的, 将被置为零, 即被稀疏掉.

1.4 建立淋巴结转移影像组学标签与预测模型

本文使用LLR对组学特征进行降维并建模, 并使用10折交叉验证, 提高模型的泛化能力, 流程如图 3所示.

将本文使用的影像组学模型的预测概率(Radscore)作为独立的生物标志物, 并与临床指标中显著的特征结合构建多元Logistics模型, 绘制个性化预测的诺模图, 最后通过校正曲线来观察预测模型的偏移情况.

2. 结果

2.1 数据单因素分析结果

我们分别在训练集和验证集上计算各个临床指标与淋巴结转移的单因素P值, 计算方式为卡方检验, 结果见表 1, 发现吸烟与否和EGFR (Epidermal growth factor receptor)基因突变状态与淋巴结转移显著相关.

表 1 训练集和测试集病人的基本情况Table 1 Basic information of patients in the training set and test set基本项 训练集($N=400$) $P$值 测试集($N=164$) $P$值 性别 男 144 (36 %) 0.896 78 (47.6 %) 0.585 女 256 (64 %) 86 (52.4 %) 吸烟 是 126 (31.5 %) 0.030* 45 (27.4 %) 0.081 否 274 (68.5 %) 119 (72.6 %) EGFR 缺失 36 (9 %) 4 (2.4 %) 突变 138 (34.5 %) $ < $0.001* 67 (40.9 %) 0.112 正常 226 (56.5 %) 93 (56.7 %) 2.2 淋巴结转移影像组学标签

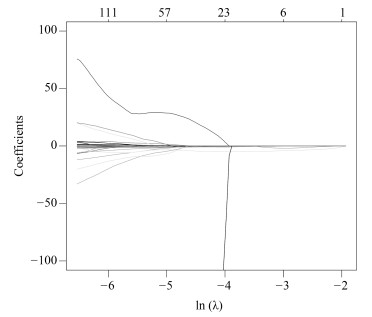

影像组学得分是每个病人最后通过模型预测后的输出值, 随着特征数的动态变化, 模型输出的AUC (Area under curve)值也随之变化, 如图 4所示, 使用R语言的Glmnet库可获得模型的参数$\lambda $的变化图.图中直观显示了参数$\lambda $的变化对模型性能的影响, 这次实验中模型选择了3个变量.如图 5所示, 横坐标表示$\lambda $的变化, 纵坐标表示变量的系数变化, 当$\lambda $逐渐变大时, 变量的系数逐渐减少为零, 表示变量选择的过程, 当$\lambda $越大表示模型的压缩程度越大.

通过套索回归方法, 自动的将变量压缩为3个, 其性能从图 4中也可发现, 模型的AUC值为最佳, 最终的特征如表 2所示. $V0$为截距项; $V179$为横向小波分解90度共生矩阵Contrast特征; $V230$为横向小波分解90度共生矩阵Entropy特征.

表 2 Lasso选择得到的参数Table 2 Parameters selected by LassoLasso选择的参数 含义 数值 $P$值 $V0$ 截距项 2.079115 $V179$ 横向小波分解90度共生矩阵Contrast特征(Contrast_2_90) 0.0000087 < 0.001*** $V230$ 横向小波分解90度共生矩阵Entropy特征(Entropy_3_180) $-$3.573315 < 0.001*** $V591$ 表面积与体积的比例(Surface to volume ratio) $-$1.411426 < 0.001*** $V591$为表面积与体积的比例; 将三个组学特征与$N$分期进行单因素分析, 其$P$值都是小于0.05, 表示与淋巴结转移有显著相关性.根据Lasso选择后的三个变量建立Logistics模型并计算出Rad-score, 详见式(9).并且同时建立SVM (Support vector machine)模型.

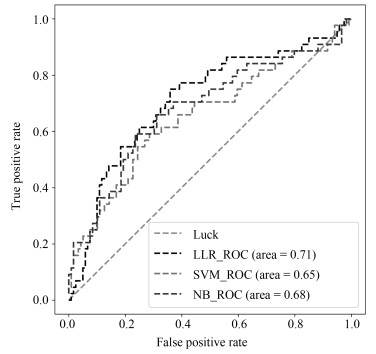

NB (Naive Bayesian)模型, 进行训练与预测, LLR模型训练集AUC为0.710, 测试集为0.712, 表现较优; 如表 3所示.将实验中使用的三个机器学习模型的结果进行对比, 可以发现, LLR的实验结果是最好的.

表 3 不同方法对比结果Table 3 Comparison results of different methods方法 训练集(AUC) 测试集(AUC) 召回率 LLR 0.710 0.712 0.75 SVM 0.698 0.654 0.75 NB 0.718 0.681 0.74 $$ \begin{equation} \begin{aligned} &\text{Rad-score}=2.328373+{\rm Contrast}\_2\_90\times\\ &\qquad 0.0000106 -{\rm entropy}\_3\_180\times 3.838207 +\\ &\qquad\text{Maximum 3D diameter}\times 0.0000002 -\\ &\qquad\text{Surface to volume ratio}\times 1.897416 \\ \end{aligned} \end{equation} $$ (9) 2.3 诺模图个性化预测模型

为了体现诺模图的临床意义, 融合Rad-score, 吸烟情况和EGFR基因因素等有意义的变量进行分析, 绘制出个性化预测的诺模图, 如图 7所示.为了给每个病人在最后得到一个得分, 需要将其对应变量的得分进行相加, 然后在概率线找到对应得分的概率, 从而实现非小细胞肺癌淋巴结转移的个性化预测.我们通过一致性指数(Concordance index, $C$-index)对模型进行了衡量, 其对应的$C$-index为0.724.

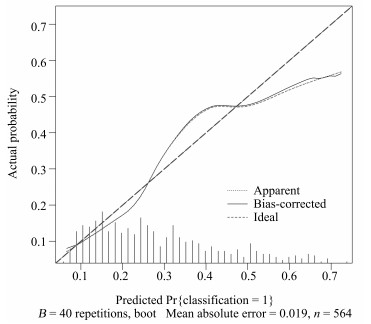

本文中使用校正曲线来验证诺模图的预测效果, 如图 8所示, 由校正曲线可以看出, 预测结果基本上没有偏离真实标签的结果, 表现良好, 因此, 该模型具有可靠的预测性能[15].

3. 结论

在构建非小细胞肺癌淋巴结转移的预测模型中, 使用LLR筛选组学特征并构建组学标签, 并与显著的临床特征构建多元Logistics模型, 绘制个性化预测的诺模图.其中LLR模型在训练集上的AUC值为0.710, 在测试集上的AUC值为0.712, 利用多元Logistics模型绘制个性化预测的诺模图, 得到模型表现能力$C$-index为0.724 (95 % CI: 0.678 $\sim$ 0.770), 并且在校正曲线上表现良好, 所以个性化预测的诺模图在临床决策上可起重要参考意义.[16].

-

表 1 算法参数说明

Table 1 Algorithm parameter description

重建方法 测试序列 压缩传感矩阵 采样点倍数 测量矩阵 傅里叶频域滤波重建 8组斯坦福公共测试序列 基于傅里叶基 0.5 多视点间隔测量矩阵 小波基稀疏重建 8组斯坦福公共测试序列 基于小波基 0.5 多视点间隔测量矩阵 多视点稀疏测量约束重建 8组斯坦福公共测试序列 基于多视点稀疏测量约束 0.5 多视点间隔测量矩阵 表 2 重建图像客观质量PSNR (平均值)比较

Table 2 Comparison of objective quality PSNR (average) of reconstructed images

重建方法 测试序列 Bracelet Bunny Cards and ball Chess Jelly Beans Knights Bulldozer Truck 傅里叶频域滤波重建 0.84 0.93 0.80 0.92 0.95 0.85 0.78 0.91 小波基稀疏重建 0.95 0.81 0.94 0.95 0.98 0.94 0.92 0.96 多视点稀疏测量约束重建 0.97 0.94 0.97 0.96 0.96 0.98 0.95 0.94 表 3 重建图像客观质量SSIM (平均值)比较

Table 3 Comparison of objective quality SSIM (average) of reconstructed images

重建方法 测试序列 Bracelet Bunny Cards and ball Chess Jelly Beans Knights Bulldozer Truck 傅里叶频域滤波重建 23.06 34.22 22.15 30.44 34.33 25.01 23.66 33.13 小波基稀疏重建 30.15 36.56 30.33 34.61 39.30 32.64 31.34 40.76 多视点稀疏测量约束重建 37.39 39.63 36..35 39.21 38.40 37.34 41.32 40.29 -

[1] Niamut O A, Kochale A, Hidalgo J R, Kaiser R, Spille J, Macq J F, et al. Towards a format-agnostic approach for production, delivery and rendering of immersive media. In: Proceedings of the 4th ACM Multimedia Systems Conference. Oslo, Norway: ACM, 2013. 249-260 [2] Deng C Y, Zhou Z G, Li W Q, Hou B Y. A panoramic geology field trip system using image-based rendering. In: Proceedings of the 40th IEEE Computer Software and Applications Conference. Atlanta, Georgia: IEEE, 2016. 264-268 [3] Doumanoglou A, Griffin D, Serrano J, Zioulis N. Quality of experience for 3-D immersive media streaming. IEEE Transactions on Broadcasting, 2018, 64(2): 379-391 doi: 10.1109/TBC.2018.2823909 [4] Zollhofer M, Stotko P, Gorlitz A, Theobalt C, Niessner M, Klein R, et al. State of the art on 3D reconstruction with RGB-D cameras. Computer Graphics Forum, 2018, 37(2): 625-652 doi: 10.1111/cgf.13386 [5] Kim C, Zimmer H, Pritch Y, Sorkine-Hornung A, Gross M. Scene reconstruction from high spatio-angular resolution light fields. ACM Transactions on Graphics, 2013, 32(4): 1-12 [6] 刘伟, 吴毅红. 基于图层优化与融合的2D-3D视频转换方法. 计算机辅助设计与图形学学报. 2012, 24(11): 1426-1439 doi: 10.3969/j.issn.1003-9775.2012.11.007Liu Wei, Wu Yi-Hong. A 2D-3D video conversion method based on layer optimization and integration. Journal of Computer-Aided Design & Computer Graphics, 2012, 24(11): 1426-1439 doi: 10.3969/j.issn.1003-9775.2012.11.007 [7] Liu W, Wu Y H, Guo F S, Hu Z Y. An efficient approach of 2D to 3D video conversion based on piece-wise structure from motion. The Visual Computer, 2015, 31(1): 55-68 doi: 10.1007/s00371-013-0904-3 [8] Wu G C, Liu Y B, Fang L, Dai Q H, Chai T Y. Light field reconstruction using convolutional network on EPI and extended applications. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2019, 41(1): 1681-1694 doi: 10.1109/TPAMI.2018.2845393 [9] Zhu H, Wang Q, Yu J Y. Light field imaging: models, calibrations, reconstructions, and applications. Frontiers of Information Technology & Electronic Engineering, 2017, 18(9): 1236-1249 [10] Chai J X, Tong X, Chan S C, Shum H Y. Plenoptic sampling. In: Proceedings of the 27th annual conference on computer graphics and interactive techniques, New York, USA: ACM, 2000. 307-318 [11] Zhang C, Chen T. Spectral analysis for sampling image-based rendering data. IEEE Transactions on Circuits and Systems for Video Technology, 2003, 13(11): 1038-1050 doi: 10.1109/TCSVT.2003.817350 [12] Do M N, Marchand-Maillet D, Vetterli M. On the bandlimitedness of the plenoptic function. In: Processings of the 2005 IEEE International Conference on Image Processing, New York, USA: IEEE, 2005. 17-20 [13] Do M N, Marchand-Maillet D, Vetterli M. On the bandwidth of the plenoptic function. IEEE Transactions on Image Processing, 2012, 21(2): 708-717 doi: 10.1109/TIP.2011.2163895 [14] Zhou P, Yu L, Zhong G. The non-lambertian reflection in plenoptic sampling. In: Proceedings of the 2013 IEEE International Conference on Image Processing. New York, USA: IEEE, 2013. 2154-2157 [15] Gilliam C, Dragotti P L, Brookes M. On the spectrum of the plenoptic function. IEEE Transactions on Image Processing, 2014, 23(2): 502-516 doi: 10.1109/TIP.2013.2292363 [16] Vagharshakyan S, Bregovic R, Gotchev A. Image based rendering technique via sparse representation in shearlet domain. In: Prceedings of International Conference on Image Processing. New York, USA: IEEE, 2015. 1379-1383 [17] Heber S, Pock T. Convolutional networks for shape for light field. In: Proceedings of the 2016 IEEE International Conference on Computer Vision and Pattern Recognition. New York, USA: IEEE, 2016. 3746-3754 [18] Kalantari N K, Wang T C, Ramamoorthi R. Learning based view synthesis for light field cameras. ACM Transactions on Graphics, 2016, 35(6): 1-10 [19] Unde A S, Deepthi P P. Block compressive sensing: Individual and joint reconstruction of correlated images. Journal of Visual Communication and Image Representation, 2017, 44: 187-197 doi: 10.1016/j.jvcir.2017.01.028 [20] Ansari N, Gupta A. Image reconstruction using matched wavelet estimated from data sensed compressively using partial canonical identity matrix. IEEE Transaction on Image Processing, 2017, 26(8): 3680-3695 doi: 10.1109/TIP.2017.2700719 [21] Vagharshakyan S, Bregovic R, Gotchev A. Light field reconstruction using shearlet transform. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2018, 40(1): 133-147 doi: 10.1109/TPAMI.2017.2653101 [22] Ji S H, Xue Y. Carin L. Bayesian compressive sensing. IEEE Transactions on Signal Processing, 2008, 56(6): 2346-2356 doi: 10.1109/TSP.2007.914345 [23] Candes E J, Romberg J, Tao T. Stable signal recovery from incomplete and inaccurate measurements. Communications on Pure and Applied Mathematics, 2006, 59(8): 1207-1223 doi: 10.1002/cpa.20124 [24] Candes E J, Romberg J, Tao T. Robust uncertainty principles: exact signal reconstruction from highly incomplete frequency information. IEEE Transactions on Information Theory, 2006, 52(2): 489-509 doi: 10.1109/TIT.2005.862083 [25] Bolles R C, Baker H H, Marimont D H. Epipolar-plane image analysis: an approach to determining structure from motion. International Journal of Computer Vision, 1987, 1(1): 7-55 doi: 10.1007/BF00128525 [26] 陈允杰, 葛魏东, 孙乐. 一种基于协同稀疏和全变差的高光谱线性解混方法. 自动化学报, 2017, 44(1): 116-128 doi: 10.16383/j.aas.2018.c160414Chen Yun-Jie, Ge Wei-Dong, Sun Le. A novel linear hyperspectral unmixing method based on collaborative sparsity and total variation. Acta Automatica Sinica, 2017, 44(1): 116-128 doi: 10.16383/j.aas.2018.c160414 [27] 常振春, 禹晶, 肖创柏, 孙卫东. 基于稀疏表示和结构自相似性的单幅图像盲解卷积算法. 自动化学报, 2017, 43(11): 1908-1919 doi: 10.16383/j.aas.2017.c160357Chang Zhen-Chun, Yu Jing, Xiao Chuang-Bai, Sun Wei-Dong. Single image blind deconvolution using sparse representation and structural self-similarity. Acta Automatica Sinica, 2017, 43(11): 1908-1919 doi: 10.16383/j.aas.2017.c160357 [28] Vaish V, Adams A. The (New) Stanford light field archive [Online], available: http://lightfield.stanford.edu, October 18, 2018 [29] 黄博学, 周彤. 利用Block-StOMP的一种改进算法高效重构块稀疏信号. 自动化学报, 2017, 43(9): 1607-1618 doi: 10.16383/j.aas.2017.e150116Huang B X, Zhou T. Efficient recovery of block sparse signals by an improved algorithm of Block-StOMP. Acta Automatica Sinica, 2017, 43(9): 1607-1618 doi: 10.16383/j.aas.2017.e150116 期刊类型引用(14)

1. 王圣洁,刘乾义,文超,李忠灿,田文华. 考虑致因的初始晚点影响列车数预测模型研究. 综合运输. 2024(02): 105-110 .  百度学术

百度学术2. 刘鲁岳,肖宝弟,岳丽丽. 基于改进RF-XGBoost算法的列车运行晚点预测研究. 铁道标准设计. 2023(03): 38-43 .  百度学术

百度学术3. 李建民,许心越,丁忻. 基于多阶段特征优选的高速铁路列车晚点预测模型. 中国铁道科学. 2023(04): 219-229 .  百度学术

百度学术4. 林鹏,田宇,袁志明,张琦,董海荣,宋海锋,阳春华. 高速铁路信号系统运维分层架构模型研究. 自动化学报. 2022(01): 152-161 .  本站查看

本站查看5. 文超,李津,李忠灿,智利军,田锐,宋邵杰. 机器学习在铁路列车调度调整中的应用综述. 交通运输工程与信息学报. 2022(01): 1-14 .  百度学术

百度学术6. 张芸鹏,朱志强,王子维. 高速铁路行车调度作业风险管控信息系统设计研究. 铁道运输与经济. 2022(03): 47-52+59 .  百度学术

百度学术7. 张红斌,李军,陈亚茹. 京沪高铁列车运行晚点预测方法研究. 铁路计算机应用. 2022(05): 1-6 .  百度学术

百度学术8. 俞胜平,韩忻辰,袁志明,崔东亮. 基于策略梯度强化学习的高铁列车动态调度方法. 控制与决策. 2022(09): 2407-2417 .  百度学术

百度学术9. 唐涛,甘婧. 基于国内外铁路运营数据的列车运行时间预测模型. 中国安全科学学报. 2022(06): 123-130 .  百度学术

百度学术10. 刘睿,徐传玲,文超. 基于马尔科夫链的高铁列车连带晚点横向传播. 铁道科学与工程学报. 2022(10): 2804-2812 .  百度学术

百度学术11. 廖璐,张亚东,葛晓程,郭进,禹倩. 基于GBDT的列车晚点时长预测模型研究. 铁道标准设计. 2021(08): 149-154+176 .  百度学术

百度学术12. 闫璐,张琦,王荣笙,丁舒忻. 基于动力学特性的列车运行态势分析. 铁道运输与经济. 2021(08): 64-70 .  百度学术

百度学术13. 张俊,张欣愉,叶玉玲. 高速铁路非正常事件下初始延误场景聚类研究. 物流科技. 2021(06): 1-4+9 .  百度学术

百度学术14. 徐传玲,文超,胡瑞,冯永泰. 高速铁路列车连带晚点产生机理及其判定. 交通运输工程与信息学报. 2020(04): 31-37 .  百度学术

百度学术其他类型引用(28)

-

下载:

下载:

下载:

下载: