-

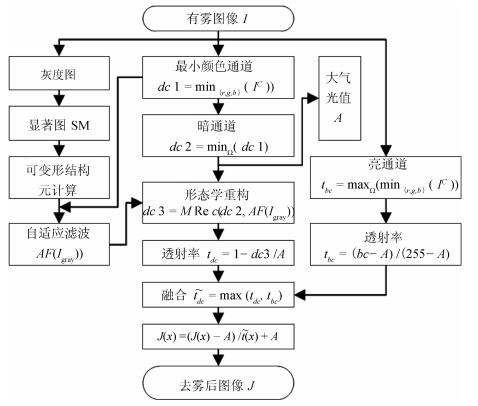

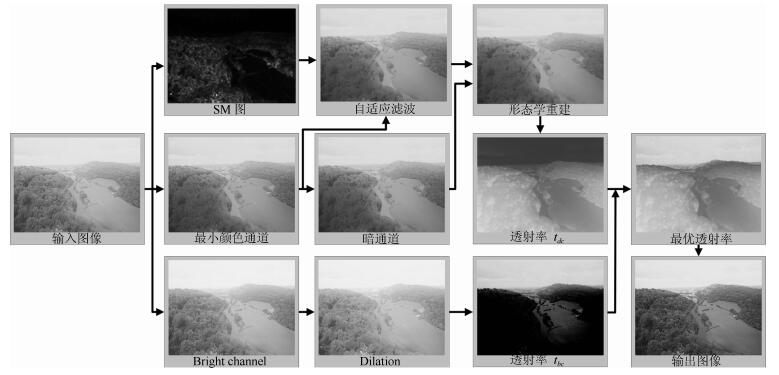

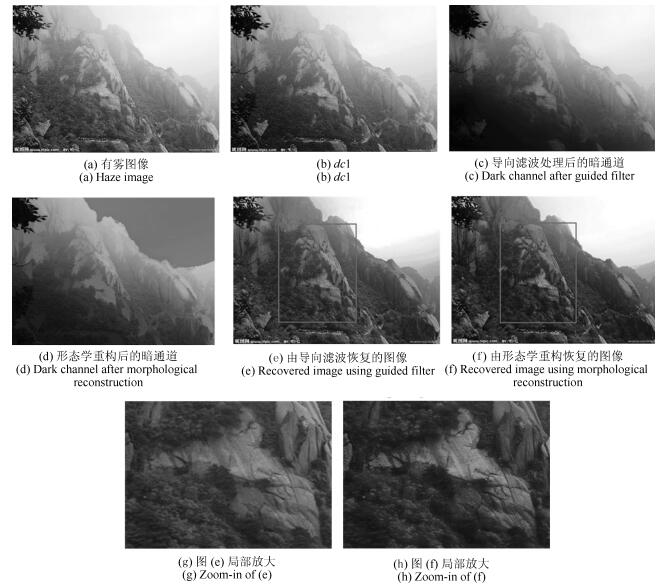

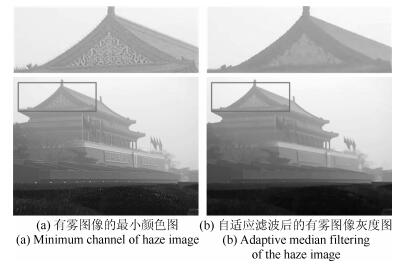

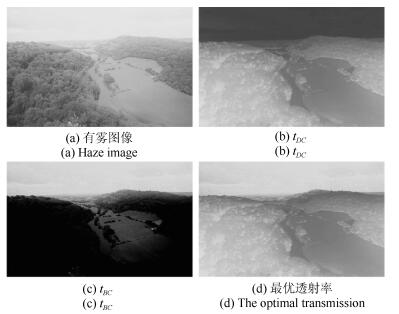

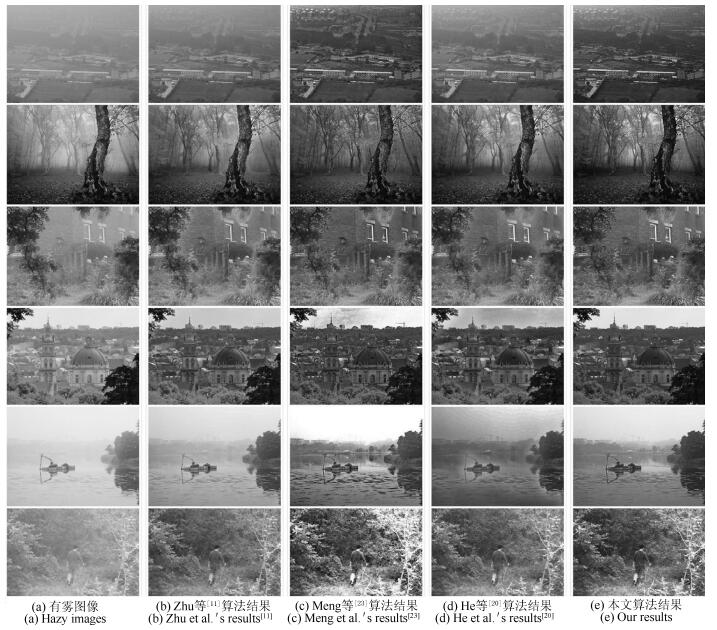

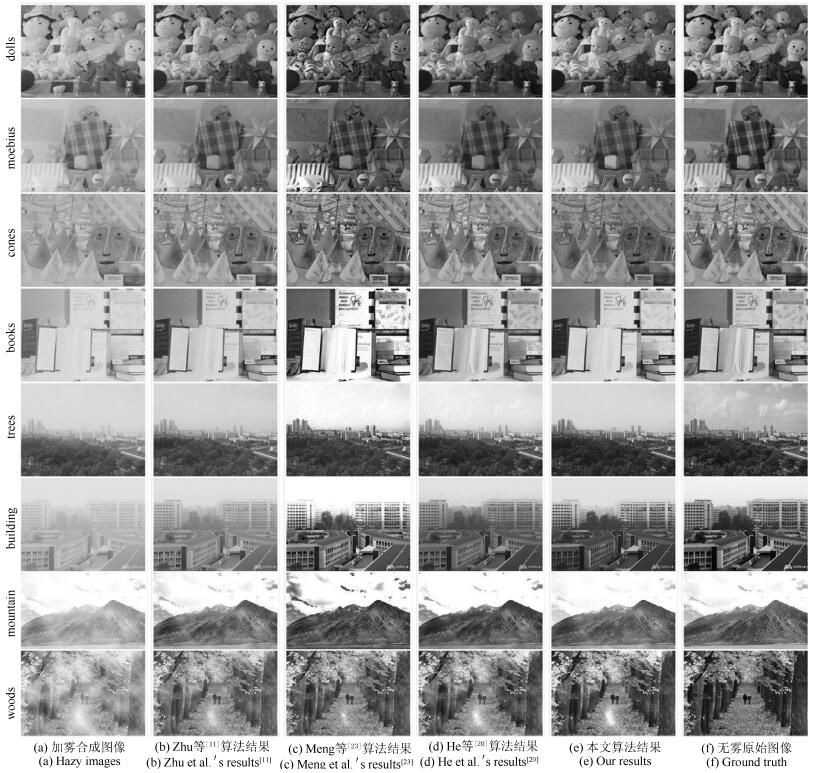

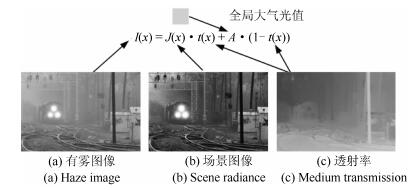

摘要: 针对暗通道先验去雾中存在的光晕现象和天空区域颜色失真现象,提出了一种基于自适应可变形结构元(Adaptive deformable structuring element,ADSE)中值滤波结合灰度形态学重构精细化透射率的方法.该方法利用透射率与图像细纹理结构的无关性,由有雾图像的灰度图计算显著图(Salience map,SM),将SM作为导向图计算ADSE,用生成的ADSE对最小颜色通道图像进行自适应中值滤波运算;其次,以粗估计暗通道图像为标记图像,以自适应中值滤波后的图像作为模板图像进行灰度形态学重构运算,获得精细化暗通道图像,继而得到精细化透射率;最后,针对天空区域,引入最优化透射率方法,对天空和非天空区域做统一的运算得到最终透射率,完成图像去雾.本文算法对真实场景具有很好的去雾效果,同时,基于形态学的运算易于并行化和硬件实现.Abstract: The dehaze image based on dark channel prior presents the phenomena of halo effect and color distortion in sky region. In this paper, the median filtering with adaptive deformable structuring element (ADSE) and the morphological reconstruction are introduced to estimate the fine transmission. The transmission does not relate to fine texture, so the median filtering can be performed on the minimum channel with ADSEs. The ADSEs can be computed by the salience map (SM) which is computed by haze image. Then, the filtered image and dark channel image of the haze image are used as the mask and marker images, respectively. The mask and marker images are used to perform morphological reconstruction for fine dark channel image and fine transmission. Finally, the transmissions in nonsky and sky regions are fused by the optimized medium transmission method. The experiment results show that the proposed method can obtain good dehazing effect, especially in real-world images. The proposed algorithm is based on morphology operations, which is easy for parallel computing and hardware implementation.

-

随着无线通信技术的进步以及无线传感器网络(Wireless sensor network, WSN)和物联网等的高速发展, 如何精确定位监控区域内的多个目标已经成为信号处理领域中极具挑战和实际意义的问题.多目标定位可以应用于诸多场景, 例如, WSN中传感器节点定位[1]、室内定位[2]、污染源定位[3]、无线电监控等.

传统的定位算法主要分为两类.一类是基于测距的定位算法, 典型算法有利用到达时间测距(Time of arrival, ToA)、利用到达时间差测距(Time difference of arrival, TDoA)、利用到达角度测距(Angle of arrival, AoA)和利用接收信号强度进行三边测距(Received signal strength indicator, RSSI)[4]; 一类是非测距的定位算法, 典型算法有DVhop定位[5]、基于信道感知定位[6]和RSSI指纹定位[7-8]等.然而这些方法都显示出一定的局限性.

近年来, 压缩感知(Compressive sensing, CS)理论的兴起[9]为我们提供了一种全新的视角去看待多目标定位问题.通过对感知区域的网格化, 目标位置在空间域上的稀疏性为压缩感知理论体系的应用提供了可能.研究表明[10-11], 基于压缩感知的多目标定位方法能够实现比传统的定位方法更好的定位性能. Cevher等[12-13]提出了WSN中多目标定位的估计框架, 提出只需少量的测量, 便可以将目标位置的稀疏向量通过传感矩阵进行恢复.在此之后, Feng等[10]开始将多目标定位问题建立在压缩感知欠定方程上, 并采取了基追踪(Basis pursuit, BP)和基追踪降噪(Basis pursuit denoising, BPDN)等恢复算法进行仿真测试及性能比较. Zhang等[11]使用贪婪匹配追踪(Greedy matching pursuit, GMP)算法替代传统的压缩感知恢复算法, 提高了恢复的准确性, 同时对传感矩阵是否满足有限等距特性(Restricted isometry property, RIP)[9]进行了证明. Lin等[14]通过融合两种网格下的恢复结果获得了分集增益, 提高了定位精度.

然而, 之前基于压缩感知定位的研究有诸多不足. 1)求解基于压缩感知的多目标定位问题时, 基于优化逼近的方法定位精度高但计算复杂, 基于贪婪恢复的方法计算简单却定位精度低; 2)简单使用一般的压缩感知恢复算法来实现定位, 忽略了多目标定位问题中丰富的结构信息, 无法有效提升定位性能; 3)为降低密集网格划分带来的强相关性, 文献中广泛采用的正交预处理方法[10]削弱了原始定位模型中的信噪比, 使得定位算法的抗噪性能大幅降低.

鉴于此, 本文针对多目标定位问题, 给出了明确的系统模型, 证明预处理方法削弱模型信噪比, 提出一种新颖的基于压缩感知的层级贪婪匹配追踪定位算法(Hierarchical greedy matching pursuit, HGMP).所提算法具有线性计算复杂度, 提供了一种利用多目标定位场景中的结构信息实现快速贪婪定位的层级架构, 提高了多目标定位系统的定位精度和抗噪声性能.

1. 系统模型

本节首先阐述基于德劳内三角剖分的空间网格化方法, 介绍基于压缩感知的多目标定位模型及各参数的意义.其次, 从压缩感知理论出发, 讨论定位问题中目标数、传感器数目、网格数目三者的相互制约关系.接着, 证明文献中广泛采用的基于正交的预处理操作本质上降低信噪比.最后, 在讨论部分阐述本文的主要动机.

1.1 空间德劳内三角网格划分

不失一般性, 设已知存在$K$个目标的二维感知区域被离散成$N$个网格点(目标服从感知区域内的连续均匀分布), 其中随机均匀散布$M$个传感器(位置已知), 每个传感器测量该点处的接收信号强度(Received signal strength, RSS).在空间网格点数目足够大的前提下, 可以用网格点近似估计目标的位置来确定$K$个目标发射源的位置.

空间网格化是构建定位模型的第一步, 文献中广泛采用均匀矩形网格划分.理论上, 三角形和四面体是二维和三维空间的单纯形, 可以剖分任意复杂的几何形状.因三角剖分具有良好的灵活性和稳定性, 20世纪80年代后, 对三角剖分的研究飞速发展, 除了在有限元分析, 流体力学等传统领域大放光彩外, 在模式识别, 虚拟现实, 计算机视觉等领域也得到广泛的应用.

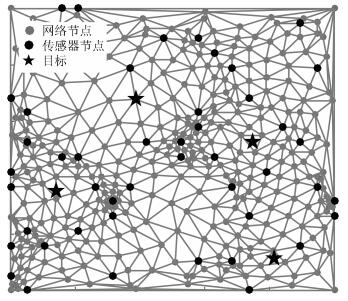

本文采用新提出的基于德劳内三角剖分的空间网格化方法(Delaunay triangulation spatial gridding, DTSG)[14]. DTSG方法利用传感器节点和四个边界点作为原始网格点, 对感知区域进行初步的德劳内三角剖分, 然后依次添加各个德劳内三角形的重心作为新的网格节点, 重新对感知区域进行德劳内三角剖分, 如此迭代分裂, 直至网格点个数满足预设大小.相比均匀矩形网格, 其具有灵活、网格多分辨率、网格密度自适应的特点. Lin等[14]的研究显示, 统计平均意义下, DTSG网格划分方法的定位性能优于传统的均匀矩形网格划分方法.而实际中, 传感器的布置符合一定的先验知识, 如在无线电监控中, 固定监测站点和移动监测平台往往布置在非法电台出现机率大的区域.所以, 这种由传感器节点位置生成网格的空间划分方法更切合实际应用.图 1给出了$M=50$, $N=441$设定下DTSG网格划分结果.其中黑色圆点为随机布置的传感器节点, 灰色圆点为依据DTSG算法生成的网格节点, 五角星为目标发射源.图 1中的目标发射源节点用于示意定位模型, 由DTSG方法可知网格划分与目标无关.

1.2 基于压缩感知的多目标定位模型

由于$K \ll N$, 所以目标的估计位置在空域上具有稀疏性.根据压缩感知理论, 多目标问题可以抽象为通过$M$维接收信号强度的有噪测量(噪声为测量噪声$n$, 近似为高斯噪声), 重建出$N$维空间中的$K$稀疏位置矢量的稀疏近似问题.模型为

$ \begin{align}\label{model1} \boldsymbol{y} = \Phi \Psi \boldsymbol{x} + \boldsymbol{n} = A\boldsymbol{x} + \boldsymbol{n} \end{align} $

(1) 其中, 称为传感矩阵, 是一个过完备字典.在模型(1)中, 我们用网格点来近似真实的目标位置.各参数的意义如下:

1) 目标稀疏位置矢量$\boldsymbol{x} \in {\bf R}_{+}^{N}$

为$K$稀疏矢量, 编码了目标在网格点中的近似位置.如果目标被近似到第$i$个网格点上时, $x_i$为与目标功率有关的正数$C$, 否则为$0$.

2) 基于RSS的稀疏基矩阵$\Psi \in {{\bf R}^{N \times N}}$

的每一列$\pmb \psi_j$代表所有网格点对网格点$j$处目标的RSS测量.在不考虑信号增益的条件下, 网格点$j$处目标在网格点$i$上的接收信号强度满足空间传播的衰落模型[10]

$ \begin{align}\label{propation1} RSS({d_{i, j}}) = {P_0} + {K_e} - 10\eta \lg \frac {{d_{i, \, j}}}{d_0} + \alpha + \beta \end{align} $

(2) 其中, $P_0$为信号发射功率, $K_e$为环境衰减因子, $d_{i, \, j}$为网格点$j$到网格点$i$的物理距离, $d_0$为近场参考距离. $\alpha$为快衰落的影响因子, $\beta$为阴影衰落的影响因子.显而易见, .不同于压缩感知原理中的稀疏基矩阵, 例如离散余弦变换基、快速傅里叶变换基、离散小波变换基等, 在多目标定位模型(1)中的稀疏基矩阵$\Psi$很可能不是$N$维空间的一个基矩阵, 即${\rm span}(\Psi)\subsetneq {{\bf R}^N}$.

3) 测量矩阵$\Phi \in {{\bf R}^{M \times N}}$

测量矩阵表示网格点中的传感器部署方案.多目标定位问题中, 稀疏基矩阵$\Phi$的前$M$列为传感器所在网格点, 所以测量矩阵形式为$\Phi =I_{M \times N}^M$ $=$ , 其中, $I_M$为$M$阶单位矩阵, 为全零矩阵.

4) 测量结果矢量$\boldsymbol{y} \in {{\bf R}^M}$

测量结果矢量$\boldsymbol{y}$为$M$个传感器的实际RSS测量结果. 中的任一元素$y_i$代表第$i$个传感器感知到的所有目标的功率叠加结果.

$ \begin{align} {y_i} = \sum\limits_{j = 1}^K {RSS({d_{i, j}})} \end{align} $

(3) 1.3 模型参数的约束关系

在多目标定位问题中, 研究者感兴趣的问题是需要多少个接收传感器才能成功定位给定数目的目标发射源?网格划分越密集, 是否定位精度会越高?借由压缩感知理论, 可以获得关于这些问题的初步结论.

对于无噪声压缩感知方程$\boldsymbol{y} = A\boldsymbol{x}$, 文献[11]证明, 若且$A$满足$(2K, \sigma)$的RIP条件, 则$\ell_1$范数最小化问题

$ \begin{align}\label{L1min} \min{\lVert \boldsymbol{x} \rVert}_{1} ~~{\rm s.t.}~~\boldsymbol{y} = A\boldsymbol{x} \end{align} $

(4) 的解为$\hat{\boldsymbol{x}}$, 若$\boldsymbol{x}$是严格$K$稀疏信号, 则; 若$\pmb x$是非严格$K$稀疏信号, 则$\hat{\boldsymbol{x}}$能重建出$\boldsymbol{x}$最主要的$K$个系数.当$\boldsymbol{y}$受到噪声污染时, 压缩感知方程(1)的$\ell_1$范数最小化解的重建误差为${{c_0}{\epsilon_0}+{c_1}{\epsilon}}$, 其中${c_0}$, ${c_1}$为很小的正常数, $\epsilon_0$为$\boldsymbol{y}$的重建允许误差范围, ${\epsilon}$为无噪声时的重建误差.

Zhang等[11]证明了多目标定位模型(1)的传感矩阵$A$以大概率满足RIP条件.所以从压缩感知的重构的角度来看, 给定网格划分结果确定了$A$的构成, 而$A$满足的RIP条件阶数又进一步确定了在当前传感矩阵下能够重构出的最大目标数$K$.同时, 为了重构出稀疏位置矢量$\boldsymbol{x}$, 传感器个数需满足$M$ $\ge$ ${\rm O}(K\lg (N/K))$.

在多目标定位问题中, 目标位置的参数空间是连续的.基于压缩感知的定位方法通过把参数空间网格离散化获得对目标位置的网格点近似估计, 然后由这些网格点构成有限离散的过完备字典(即传感矩阵$A$).网格划分越精细, 网格点和真实目标之间的误差就越小, 但过密的网格会造成稀疏基字典中原子间的相关性越强, 进而使得压缩感知的重构性能下降[15], 有如下定理[12].

定理1 [12]. 令$A \in {{\bf R}^{M \times N}}$为一个过完备字典, $\boldsymbol{a_j}$为其第$j$列, 定义相干性(Coherence) $\mu(A)$为

$ \begin{align} \mu \left( A \right) = \mathop {\max }\limits_{1 \le i \ne j \le N} \frac{{\left| {\left\langle {\boldsymbol{a_i}, \boldsymbol{a_j}} \right\rangle } \right|}}{{{{\left\| {\boldsymbol{a_i}} \right\|}_2}{{\left\| {\boldsymbol{a_j}} \right\|}_2}}} \end{align} $

(5) 令$K \le 1 + 1/16u$, 当$M \ge {\rm O}(K\lg (N/K))$时, 任何$K$稀疏向量$\boldsymbol{x}$可以从测量$\boldsymbol{y} = A\boldsymbol{x}$中通过求解式(4)以大概率恢复.

Cevher等[12]的研究表明, 在基于压缩感知的多目标定位场景中, $ \mu \left( A \right) $依赖于$\Delta /2D$.其中$\Delta$为网格精度, $D$为网格点和传感器之间的最大距离(由传感器部署和网格划分共同决定).从而, $\Delta$决定能够成功定位的目标数的下界, 而$D$决定其上界.

另一方面, 为了缓解密集网格划分造成的传感矩阵各列之间的强相关性对压缩感知重建性能的影响, Feng等[10]提出一种基于正交的预处理方法降低了原始传感矩阵各列之间的相关性.此后, 这种预处理方法被研究者广泛使用[10, 14, 16], 下面对基于正交的预处理方法做出了详细介绍, 并证明在有噪情况下, 其本质上放大了噪声的影响, 降低了信噪比.

1.4 基于正交的预处理方法及其不足

定义1 (预处理算子T). 给定模型$\boldsymbol{y} = A\boldsymbol{x}+\boldsymbol{n}$, 定义线性预处理算子为.其中, $A^†$表示$A$的伪逆, 表示对矩阵$A$的规范正交化操作.

设矩阵$A \in {\bf R}_r^{M \times N}$有SVD分解, 其中$U$和$V$均为正交矩阵, $\Sigma$的主对角线元素为$A$的奇异值, 非主对角元素为$0$. $r$为$A$的秩, $r \le M$.对测量结果矢量进行预处理

$ \begin{align} T\boldsymbol{y} = &\ T ( A\boldsymbol{x} + \boldsymbol{n} ) = \notag \\ &\ { V^{\rm T}(:, 1:r) } V {\Sigma ^† } { U^{\rm T} } ( U \Sigma{ V^{\rm T} }\boldsymbol{x} +\boldsymbol{n} ) = \notag \\ &\ {V^{\rm T}(:, 1:r) } \boldsymbol{x} + \boldsymbol{n}' \end{align} $

(6) 其中, $\boldsymbol{n}' = I_{r \times N}^r{\Sigma ^† }{U^{\rm T}}\boldsymbol{n}$.记$\boldsymbol{z} = T\boldsymbol{y}$, 经过预处理后, 多目标定位模型(1)可以表示为

$ \begin{align}\label{model2} \boldsymbol{z}= Q\boldsymbol{x} + \boldsymbol{n}' \end{align} $

(7) 其中, $V(:, 1:r)$为正交矩阵$V$的前$r$列构成的子矩阵.可以证明, 正交矩阵的随机子矩阵满足RIP条件[17].下文中, 称模型(1)为原始模型, 模型(7)为预处理模型, 相应地, $A$称为原始传感矩阵, $Q$称为预处理传感矩阵.

可见, 相对原始传感矩阵$A$, 预处理传感矩阵$Q$的列间相关性已被大大降低.但预处理算子$T$并不是一个无损操作.从原始模型(1)到预处理模型(7), 相对信号功率, 预处理算子$T$放大了噪声水平, 即预处理算子$T$削弱了信噪比(Signal to noise ratio, SNR), 有如下定理.

定义2 (信噪比SNR). 给定模型$\boldsymbol{y} = A\boldsymbol{x} + \boldsymbol{n}$, $\boldsymbol{x}$为随机向量.其中信号为$A\boldsymbol{x}$, 噪声.模型信噪比定义为

$ \begin{align} SNR = \frac{{\rm E}({\lVert A\boldsymbol{x} \rVert}_2^2)}{{\rm E}({\lVert \boldsymbol{n} \rVert}_2^2)} \end{align} $

(8) 定理2. 给定模型$\boldsymbol{y} = A\boldsymbol{x} + \boldsymbol{n}$, 其中$A \in {\bf R}_M^{M \times N}$, 为随机向量且各分量$x_i$满足i.i.d. 条件.模型信噪比为$SNR_1$.对应预处理模型为, 模型信噪比为$SNR_2$.如果存在E$(x_i^2)$, $i=1, 2, \cdots, N$, 则$SNR_2$ $\le$ $SNR_1$.

证明. $A =U \Sigma_1 V^{\rm T}$.其中,

$ \Sigma_1 =[\Sigma \, \, O_{M \times (N-M)}], \ \ \Sigma = {\rm diag}\{s_1, s_2, \cdots, s_M\} $

$s_i$为$A$的奇异值.

记$V^{\rm T}\boldsymbol{x}=(v_1, v_2, \cdots, v_N)^{\rm T}$, , $1/s_2$, $\cdots, 1/s_M\}$.所以

$ \begin{align*} &\lVert A\boldsymbol{x}\rVert_2^2 = \boldsymbol{x}^{\rm T}V\Sigma_1^{\rm T}U^{\rm T}U{\Sigma_1}V^{\rm T}\boldsymbol{x}=\mathop\sum\limits_{i=1}^{M}{s_i^2}{v_i}^2\\ &T=QA^† =[I_M, O_{M\times(N-M)}]V^{\rm T}\\ &\lVert TA\boldsymbol{x}\rVert_2^2 = \!\boldsymbol{x}^{\rm T}V\Sigma_1^{\rm T}U^{\rm T}U\Sigma^{†}\Sigma^{†}U^{\rm T}U{\Sigma_1}V^{\rm T}\boldsymbol{x}=\!\mathop\sum\limits_{i=1}^{M}{v_i}^2\\ &{\rm E}(\boldsymbol{n}^{\rm T}\boldsymbol{n})=M\sigma^2 \end{align*} $

接下来考虑${\rm E}\{\lVert T\boldsymbol{n}\rVert_2^2\}$:

$ {\rm E}\left\{ {\lVert T\boldsymbol{n}\rVert}_2^2 \right\}={\rm E}\left\{ {\lVert \Sigma^{†}U^{\rm T}\boldsymbol{n}\rVert}_2^2 \right\} $

令$\boldsymbol{z}=U^{\rm T}\boldsymbol{n}$, $U$为正交矩阵.因为高斯白噪的正交变换仍为高斯白噪.所以, $ \boldsymbol{z}\sim {\rm N}(0, \sigma^{2}I)$.从而有

$ {\rm E} \left\{ {\lVert \Sigma^{†}U^{\rm T}\boldsymbol{n}\rVert}_2^2 \right\} ={\rm E}\left\{ {\mathop\sum\limits_{i=1}^{M}{\dfrac{z_i^2}{s_i^2}}}\right\}= {\mathop\sum\limits_{i=1}^{M}{\dfrac{\sigma^2}{s_i^2}}} $

所以

$ \begin{align} &\frac{SNR_1}{SNR_2} = \frac{{\rm E}({\lVert A\boldsymbol{x} \rVert}_2^2){\rm E}({\lVert T\boldsymbol{n} \rVert}_2^2)} {{\rm E}({\lVert TA\boldsymbol{x} \rVert}_2^2){\rm E}({\lVert \boldsymbol{n} \rVert}_2^2)} \notag = \\ &\qquad \frac{{\rm E}\left(\mathop\sum\limits_{i=1}^{M}{s_i^2}{v_i}^2\right)\mathop\sum\limits_{i=1}^{M}{\frac{\sigma^2}{s_i^2}}} {{\rm E}\left(\mathop\sum\limits_{i=1}^{M}{v_i}^2\right)M\sigma^2}= \frac{\mathop\sum\limits_{i=1}^{M}{s_i^2}\mathop\sum\limits_{i=1}^{M}{\frac{1}{s_i^2}}} {M^2}\notag \end{align} $

由Cauchy-Schwarz不等式, 有

$ \begin{align} \mathop\sum\limits_{i=1}^{M}{s_i^2}\mathop\sum\limits_{i=1}^{M}{\frac{1}{s_i^2}} \ge \left(\mathop\sum\limits_{i=1}^{M}{s_i \frac{1}{s_i}}\right)^2=M^2 \notag \end{align} $

综上所述

$ \begin{align} SNR_2 \le SNR_1 \notag \end{align} $

等号成立的条件为: $A$的所有奇异值都为1.

在多目标定位模型(1)中, 按照空间传播损耗模型构建的原始传感矩阵$A$, 其奇异值一般远小于1, 根据定理2, 经过预处理算子$T$处理后, 预处理模型(7)的信噪比将远小于原始模型(1)的信噪比.

1.5 讨论

由上述分析可知, 密集划分网格会造成$A$各列间的强相关性, 进而影响重建性能.而文献中为降低列间相关性而采取的正交预处理操作又被证明是放大噪声影响, 降低模型信噪比.然而, 对于定位场景, 只有目标附近的字典原子才会对真实的信号构成具有明显贡献, 远离目标的位置的原子划分并不会给定位带来益处.所以, 对于给定的网格化空间和相应的过完备字典$A$, 可以将观测子空间视为信号子空间和噪声子空间的叠加.

此外, 在求解压缩感知定位问题上, 文献中采用的$\ell_1$范数最小化方法, 例如BP算法, 定位精度高, 抗噪声性能强, 但当$N$很大时, 其${\rm O}(N^3)$的计算成本过于昂贵. RIP条件意味着$A$近似正交的, 这启发了一系列通过迭代求解$\boldsymbol{x}$的$K$个最大稀疏的贪婪算法, 例如正交匹配追踪算法(Orthogonal matching pursuit, OMP)等.这些贪婪算法通常具有直观, 易于理解, 计算简单的优点.但在定位问题中, 其对噪声较为敏感, 且容易陷入局部最优解中.

所以, 本文的主要动机为以贪婪重建的方式, 利用多目标定位场景中隐含的结构信息, 从观测子空间中分离出信号子空间, 降低测量噪声和网格密集划分所带来的强相关性的影响, 提升贪婪恢复的定位准确性.更具体地, 原始模型(1)中隐藏着丰富的结构信息, 预处理模型(7)适合于贪婪求解, 利用原始模型(1)和预处理模型(7)进行联合迭代贪婪定位, 将获得更优异的定位表现.

2. 层级贪婪匹配追踪定位算法

本节首先分析多目标定位场景中隐含的结构信息.其次, 利用这些结构信息提出一种分层贪婪匹配追踪的多目标定位方法(HGMP).最后, 对所提算法的收敛性和计算复杂度做出分析.

2.1 多目标定位场景中的结构信息

1) 团块模式

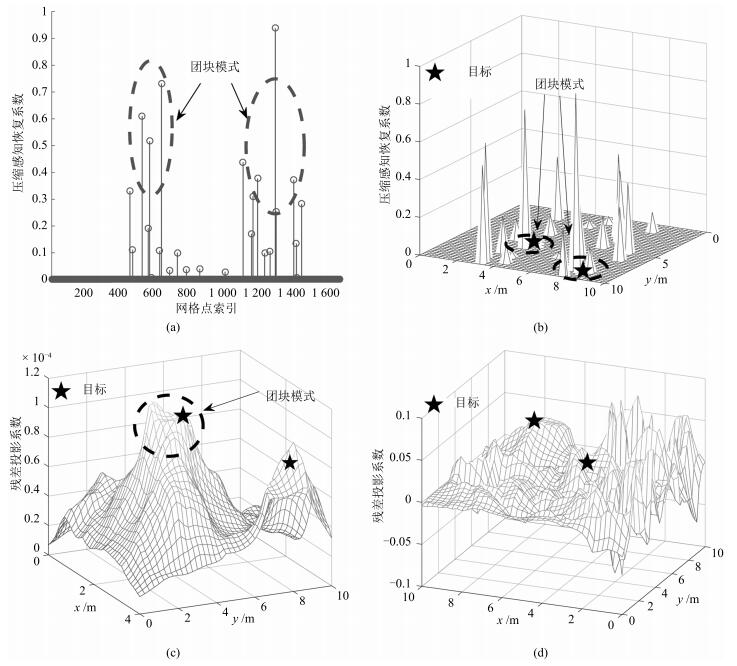

原始模型(1)是对多目标定位问题的网格点近似, 真实的目标位置可能分布在感知区域的任何位置, 不一定精确地在网格点上.所以, 接收信号投影到网格空间上的能量将分散在真实目标附近的原子团上.迭代过程中, 残差投影到网格空间上的能量将分散在对当前残差贡献最大目标附近的原子团上.具体地, 在真实目标位置附近的网格点上, 压缩感知恢复系数或残差在网格空间上的投影具有相近的取值, 且幅度明显高于远离目标位置的网格点上的, 称这种模式为团块模式.图 2 (a)和2 (b)分别展示的是恢复系数在网格点索引集上和网格空间上的团块模式. Yang等[16]注意到了恢复系数的团块模式, 其在BP算法的定位结果上利用KNN聚类对恢复位置进行加权平均, 鉴于BP算法的计算复杂度, 其很难被应用到实际中; 图 2 (c)展示的是在原始传感矩阵$A$上在OMP算法迭代过程中残差的团块模式, 可以清晰看到, 左边的目标对当前残差贡献最大, 其附近的原子团呈现出明显的团块模式; 图 2 (d)展示的是预处理传感矩阵$Q$上OMP算法迭代过程中残差在网格空间上的投影, 由于基于正交的预处理操作打乱了原始传感矩阵$A$中的相关性, 所以不再具有明显的团块模式.本文研究OMP算法迭代过程中残差在原始传感矩阵A的团块模式.

2) 冗余信息

如前所述, 为了在多目标定位问题中应用贪婪类压缩感知恢复算法, 文献中常采用预处理算子$T$.数学上, $T$是一个不可逆算子, 它把$M$维非稀疏矢量$\boldsymbol{y}$映射成$r$维()矢量$\boldsymbol{z}$, 再通过$\boldsymbol{z}$重建$N$维$K$稀疏矢量$\boldsymbol{x}$.前文的分析显示, $T$放大噪声的影响, 降低模型信噪比.此外, 预处理传感矩阵$Q$是一个正交矩阵的子矩阵, 相对原始传感矩阵而言, 其列之间的相关性已被大大降低.所以相对原始模型(1), 预处理模型损失了冗余的信息.对于一个系统来说, 冗余虽然带来有效性的降低, 但是另一方面, 却是系统可靠性的重要保障.在多目标定位问题中, 这种冗余信息的损失可以从$A$和$Q$的列相关性中得到解释. $A$中的每一列$\boldsymbol{a_j}$代表所有传感器对网格点$j$处目标的RSS测量, 空域中网格点$i$和网格点$j$距离越近, $\boldsymbol{a_i}$和$\boldsymbol{a_j}$就越相关.所以$A$的列之间的相关性具有清晰的物理意义.作为这种相关性在残差投影上的反映, 投影结果也会在空域上呈现出清晰的相关性, 如图 2 (c)所示, 残差在原始传感矩阵$A$上的投影呈现出清晰的团块模式.与此相反, 预处理传感矩阵$Q$是正交矩阵$V$的子矩阵, $Q$的列相关性已经无法直接体现空域上网格点间的相关性.如图 2 (d)所示, 残差在传感矩阵$Q$上的投影无清晰的团块模式.

2.2 算法步骤

提出的HGMP算法是一种层级的贪婪算法, 利用多目标定位场景中的结构信息, 具有线性计算复杂度和很好的可解释性. HGMP算法的思想是以贪婪的方式, 逐步发掘多目标定位问题中的残差在原始传感矩阵中投影的团块模式, 进而利用预处理模型获得贪婪恢复.算法特征为:全局估计层获得目标可能位置的全局估计, 稀疏恢复层利用全局估计信息进行目标稀疏位置矢量压缩感知贪婪重建.有以下核心算法步骤.

输入. 测量结果矢量$\boldsymbol{y}$, 原始感知矩阵$A$, 目标数$K$;

输出. 目标位置恢复点集$P$, $\boldsymbol{x}$的$K$稀疏逼近$\hat{\boldsymbol{x}}$;

初始化. 候选集$\Omega \leftarrow \phi $, 残差相关集$\Lambda \leftarrow \phi $, 删除集$\Delta \leftarrow \phi $, 残差$\boldsymbol{v} \leftarrow \boldsymbol{y}$, 格点索引集$\mathbb{N} \leftarrow \{ 1, 2$, $\cdots$, $N\}$;

预处理. 计算预处理感知矩阵$Q$, 计算;

全局估计层. 迭代量, 循环执行步骤$1$ $\sim$ $5$.

步骤1. 寻找对当前残差贡献最大的原子团$\Lambda$ $\leftarrow$ $\{ j| \langle {\boldsymbol{v}, \boldsymbol{a_j}} \rangle > Th( {\boldsymbol{v}, A} )$, ;

步骤2. 利用$\boldsymbol{z}$和$Q$, 在中进行局部正交匹配追踪, 得到$\Lambda$上的的恢复系数$\boldsymbol{\theta}$及其支撑集$\Pi$;

步骤3. 对$\boldsymbol{\theta}$及其支撑集$ \Pi$正则化, 结果为;

步骤4. 迭代更新. , ${\Delta \leftarrow \Delta \cup \Omega}$, $\boldsymbol{v}$ $\leftarrow$ $\boldsymbol{y}-A_{\Omega }A_{\Omega }^{†} \boldsymbol{y}$, ${i \leftarrow i + 1}$;

步骤5. 如果, 进入下一次迭代, 返回步骤1;否则, 进入稀疏恢复层, 执行步骤6;

稀疏恢复层.

步骤6. 扩大候选集

$ {\Omega \leftarrow \Omega \cup \left\{ {l\left. {\left| {l \in Neighbor(j, D), j \in \Omega , l \in \mathbb{N} \backslash \Omega } \right.} \right\}} \right.} $

步骤7. 利用$\boldsymbol{z}$和$Q$, 在候选集$\Omega$中进行正交匹配追踪, 得到$\boldsymbol{x}$的$K$稀疏逼近$\hat{\boldsymbol{x}}$及其支撑集$P$; 其中, $A_\Omega$表示$A$的索引集为$\Omega$的列构成的子矩阵.步骤1中, $Th(\boldsymbol{v}, A)$是自适应动态门限, 定义为

$ {Th(\boldsymbol{v}, A)=\max \{ A_{\mathbb{N} \backslash \Delta}^{\rm T}\boldsymbol{v} \}-{\rm std}(\{ A_{\mathbb{N} \backslash \Delta}^{\rm T}\boldsymbol{v} \}} $

动态门限能够自适应地提取对当前残差贡献最大的原子团, 噪声水平高时, 残差投影系数的方差较大, 动态门限自适应地降低门限值来对抗噪声的干扰, 保证空域上与当前残差相关的目标附近格点能够被选入残差相关集$\Lambda$.反之, 当噪声水平低时, 动态门限会提高门限值, 减少选入残差相关集$\Lambda$中弱相关格点的数目.

步骤3中, 正则化[18]处理旨在从恢复系数中找出幅度相近且具有最大能量的子集.给定恢复系数$\theta$及其下标集合$\Pi$, 在集合$\Pi$中寻找子集$\Pi_0$, 满足

$ \left| {\theta_i} \right| \le 2\left| {\theta_j} \right|, \quad\forall i, j \in {\Pi _0} $

正则化操作选择所有满足要求的子集$\Pi_0$中具有最大能量(的$\Pi_0$作为输出.

步骤6中, $Neighbor(j, D)$指在空域上与格点$j$的欧氏距离小于门限值的格点集合.

2.3 讨论和分析

1) 收敛性和抗噪声性能

不同于一般的基于压缩感知的定位方法, HGMP通过全局估计层获得目标可能位置的候选原子集合, 然后稀疏重建层在候选原子集合上获得最终的稀疏贪婪重建结果.这等效于从观测空间中分离出信号子空间, 然后在信号子空间上进行贪婪正交匹配追踪.在进行全局估计时, 利用原始传感矩阵$A$上残差投影的团块模式, 筛选出对当前残差贡献最大的原子团, 然后利用预处理传感矩阵$Q$易于贪婪恢复的优势获得局部正交匹配追踪恢复结果, 最后通过正则化处理从局部恢复结果中挑选出能量最大且贡献类似的原子团.由正则化操作的分析[18]可知, 最终全局估计层的输出原子团中一定包含OMP最终估计的$K$个原子, 而稀疏重建层算法是子空间上的OMP算法.所以, 在高信噪比条件下, HGMP将和OMP算法保持一致的收敛性.当信噪比较低时, OMP算法易受噪声干扰, 陷入局部最优解中, 而HGMP挑选原子的方法比OMP更为谨慎, 每次挑选出原子团而非单个最相关原子的模式也使得算法对噪声的鲁棒性更强.全局估计层把可能位置从$\mathbb{N}$缩小到候选集$\Omega$, 已经极大地去除了噪声造成的虚假目标位置候选点.所以, 在此基础上进行贪婪恢复定位具有明显的抗噪声优势.

2) 计算复杂度

步骤1中投影操作实质是矩阵向量乘法, 门限比对操作实质是一个遍历过程, 所以步骤1的复杂度为.

步骤2把残差的能量正交投影到残差相关集$\Lambda$上, 实质上是一个OMP子问题, 复杂度为, 其中$C_1 = card(\Lambda)$且$C_1 \ll N$.

步骤3中正则化操作实质上是大小为$C_1$的数集上的排序和二重循环遍历过程, 复杂度为 $+$ $K^{2})$.

步骤4在候选集$\Omega$中更新残差涉及一个最小二乘问题, 复杂度为, 其中$C_2 =card(\Omega)$, 且满足$C_2 \ll N$.

步骤6扩大候选集, 包含$C_2$个遍历格点集合的操作, 复杂度为.

所以, 全局恢复层的复杂度为${\rm O}(K(MN +$ $MC_1^2$ $+$ .渐进地, 当$N$很大时, 占主导作用, 全局估计层的渐进复杂度为${\rm O}(KMN)$.

稀疏恢复层是候选集上的稀疏度为$K$的OMP操作, 其复杂度为.

综上所述, 当$N$较小时, HGMP算法计算复杂度不高于.当$N$很大时, HGMP算法的渐进复杂度为${\rm O}(KMN)$.

3. 算法仿真

为验证所提算法在抗噪性能和计算复杂度方面的提升, 采用经典的OMP算法和BP算法作为对比.此外, 为了对比算法在DTSG网格划分和均匀矩形网格划分上的性能, 对于同样的仿真参数设置, 每一次蒙特卡洛仿真中在两种网格上分别进行定位.仿真的硬件环境为Intel Core i7-6700处理器, 主频3.4 GHz, 8 GB内存; 软件环境为Windows 10 + MATLAB R2016a.

3.1 评价度量

平均定位正确率(Mean localization accuracy rate, MLAR).如果在距离真实目标$T_i$小于1 m的范围内能够找到恢复点$\hat{T_i}$, 认为目标$T_i$被成功定位, 恢复点$\hat{T_i}$被称为目标$T_i$的匹配恢复点.把被成功定位的目标个数${\#Successful\_Localized\_Targets}$与总目标个数${\#Targets}$的比值记为恢复的正确率.

$ \begin{align} MLAR = \frac{{\#Successful\_ Localized\_Targets}}{{\#Targets}} \end{align} $

(9) 平均定位误差距离(Mean localization error distance, MLED)定义为目标$T_i$的真实位置$({x_i}$, ${y_i})$和最近的匹配恢复点位置$({\hat{x}_i, \hat{y}_i})$之间的平均欧氏距离, 公式为

$ \begin{align} MLED = \frac{1}{K}\sum\limits_{i = 1}^K {\sqrt {{{({x_i} - {{\hat x}_i})}^2} + ({y_i} - {{\hat y}_i})^2} } \end{align} $

(10) 平均运行时间(Mean run time, MRT)指每次蒙特卡洛仿真中算法运行时间的平均值, 以此来评价算法的时间复杂度.

3.2 仿真参数选择

感知区域设为$10\, {\rm m} \times 10\, {\rm m}$的方形区域, 网格点$N$ $=21 \times 21$, 目标数$K = 4$.目标有效全向辐射功率.稀疏基字典$\Psi$采用IEEE802.15.4标准中的室内传播损耗模型[14].

$ \begin{align} & RSS(d) = \begin{cases} {P_t} - 40.2 - 20\lg d, &D \le 8\\ {P_t} - 58.5 - 33\lg \frac{d}{8}, &D > 8 \end{cases} \end{align} $

(11) 测量噪声为高斯白噪声, 为了有效验证算法的定位性能, 消除随机因素的影响, 取3 000次仿真的均值作为实验结果(每一次仿真均重新撒布目标和传感器, 重新构造空间网格).

3.3 仿真结果和分析

下文中均匀矩形网格划分简称为矩形网格, DTSG网格划分简称为三角网格.

1) 抗噪声性能和计算复杂度

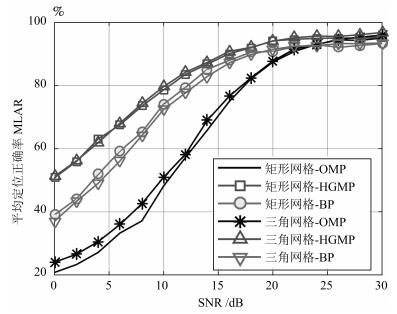

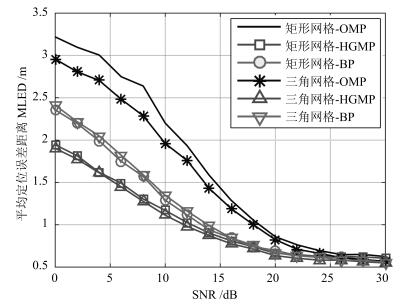

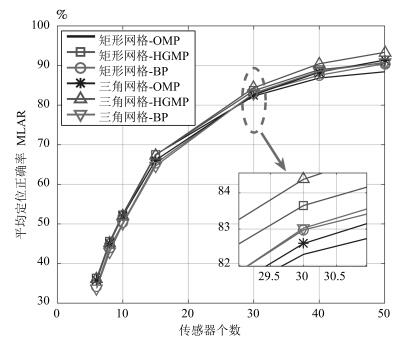

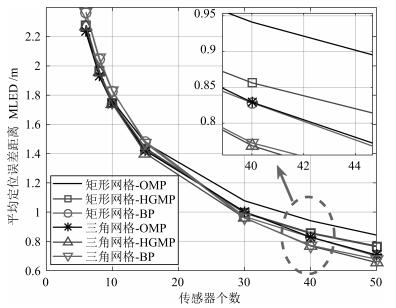

图 3和图 4分别给出了$M=50$时, 在均匀矩形网格划分和DTSG网格划分下各算法的平均定位正确率和平均定位误差距离受信噪比的影响.可以看出:

a) 随着信噪比的增加, 各算法的平均定位正确率不断上升, 平均定位误差距离不断下降.当SNR $>$ 25 dB时, BP和OMP的定位性能趋于收敛, 当SNR $>$ 22 dB时, HGMP的定位性能趋于收敛.由于基于压缩感知的多目标定位模型是对真实目标位置的一个逼近模型, 当信噪比大于一定程度时, 多目标定位问题中的测量噪声不再是主要矛盾.对于图 3, 限制MLAR继续增加的主要因素为定义成功定位的精度(仿真中为1 m)和网格精度(网格划分带来的模型逼近误差, 仿真中平均网格间距为0.5 m); 对于图 4, 限制MLED继续降低的主要因素为网格精度.

b) 在统计平均意义上, 对于BP算法和HGMP算法, DTSG三角网格划分和传统的均匀矩形网格划分的定位性能保持一致; 对于OMP, 在同样的噪声水平下, 三角网格划分能实现比均匀矩形划分更高的定位正确率和更低的定位误差距离.

c) 在噪声占主要影响因素的前提下(SNR $<$ 25 dB), 通过在迭代过程中利用残差的团块模式, 限制在信号子空间上进行贪婪重建, HGMP的定位正确率和定位误差距离优于BP的, 远远优于OMP的, 显示出良好的抗噪能力.

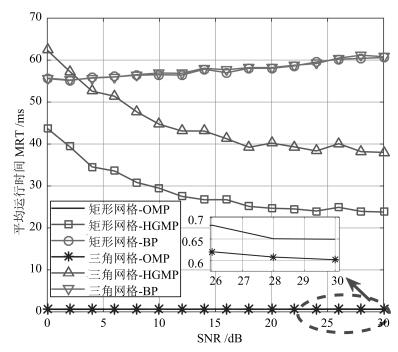

图 5给出上述实验过程中各算法的平均运行时间. HGMP算法的计算复杂度显著低于BP算法.随着信噪比的提高, HGMP的平均运行时间降低.这是因为噪声水平越低, 残差投影的团块结构越明显, 投影方差越小, 每次选入残差相关集$\Lambda$中的格点数目也越少, 从而运行时间也越少.同样的噪声水平下, HGMP算法在三角网格划分上的运行时间要高于矩形网格划分的, 近似是矩形网格划分的常数倍.这是因为计算残差相关集采取的动态门限函数和残差投影标准差相关, 由于三角网格划分的非均匀性和非规则性, 其投影方差大于均匀矩形网格划分的, 导致三角网格中的残差相关集包含更多的格点, 使得三角网格上的运行时间高于矩形网格上的.相对BP算法和HGMP算法, OMP只包含投影、最小二乘、更新残差三个步骤, 所以其计算最为简单, 但从图 3和图 4可以看出, OMP低计算复杂度的代价是对噪声敏感, 当SNR较低时, 定位性能低于HGMP和BP.

2) 传感器个数的影响

图 6和图 7分别给出了$SNR = 25$ dB条件下, 传感器数目为6, 8, 10, 15, 30, 40, 50时, 均匀矩形网格划分和DTSG网格划分下各算法的平均定位正确率和平均定位误差距离.可以清晰看出, 随着传感器的个数不断增加, 各算法的平均定位正确率不断上升, 平均定位误差距离不断下降, 但变化趋于平缓.对于$K=4$, $M=441$, 理论上需要传感器的下界为.从图 6和图 7可以看出, 当传感器个数小于20时, 所有算法的平均定位误差距离都大于1 m, 平均定位正确率小于70 %.当传感器个数大于30时, 除了在矩形网格划分上的OMP算法外, 其他算法的平均定位误差距离都小于1 m, 相应的平均定位正确率大于82 %.统计意义上, 对于1 m范围的成功定位精度, 经验值和理论值之间的差距为11个传感器.其次, 对于同一传感器数目, HGMP在DTSG三角网格划分和均匀矩形网格划分下都显示出优于其他算法的定位性能, 且在DTSG三角网格划分下的HGMP定位性能最优.

4. 结论

本文给出了一种新颖的基于压缩感知的多目标分层贪婪匹配定位方法(HGMP), 并证明了文献中广泛采用的正交预处理操作降低定位信噪比.所提算法从观测子空间中分离出信号子空间, 利用原始传感矩阵和预处理传感矩阵进行联合迭代贪婪定位, 提供一种利用多目标定位问题中丰富的结构信息实现鲁棒性贪婪定位的层级架构.理论分析和计算仿真表明, HGMP定位算法具有渐进线性复杂度${\rm O}(KMN)$.相同信噪比下, HGMP在不同网格划分上均展示出更好的定位性能.

-

表 1 不同算法去雾结果定量评价指标值

Table 1 Results of MSE and SSIM on the synthetic images

指标 图像 [11] [23] [20] 本文 MSE dolls 0.0876 0.0987 0.0598 0.0562 moebius 0.1033 0.0968 0.0795 0.0817 cones 0.0880 0.0749 0.0563 0.0770 books 0.1043 0.1517 0.0485 0.0906 trees 0.1183 0.1726 0.1244 0.0848 buildings 0.2213 0.1558 0.1054 0.1030 mountain 0.0629 0.1448 0.0822 0.0596 woods 0.2203 0.1556 0.1679 0.1498 SSIM dolls 0.9091 0.9042 0.9293 0.9366 moebius 0.8764 0.9017 0.9168 0.8908 cones 0.9051 0.9518 0.9494 0.9116 books 0.8659 0.8338 0.9436 0.8793 trees 0.8332 0.8585 0.8731 0.8998 buildings 0.6615 0.8536 0.7847 0.8541 mountain 0.9225 0.8449 0.9019 0.9240 woods 0.8469 0.9156 0.8655 0.9384 表 2 不同算法去雾运算时间(s)

Table 2 Computing times on the haze images (s)

-

[1] Narasimhan S G, Nayar S K. Vision and the atmosphere. International Journal of Computer Vision, 2002, 48 (3): 233-254 http://www.wanfangdata.com.cn/details/detail.do?_type=perio&id=b619651bb1a84a4d7a31d397fb0f9386 [2] He K M, Sun J, Tang X O. Single image haze removal using dark channel prior. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2011, 33 (12): 2341-2353 doi: 10.1109/TPAMI.2010.168 [3] 吴迪, 朱青松.图像去雾的最新研究进展.自动化学报, 2015, 41 (2): 221-239 http://www.aas.net.cn/CN/abstract/abstract18603.shtmlWu Di, Zhu Qing-Song. The latest research progress of image dehazing. Acta Automatica Sinica, 2015, 41 (2): 221-239 http://www.aas.net.cn/CN/abstract/abstract18603.shtml [4] Stark J A. Adaptive image contrast enhancement using generalizations of histogram equalization. IEEE Transactions on Image Processing, 2000, 9 (5): 889-896 doi: 10.1109/83.841534 [5] McCann J. Lessons learned from Mondrians applied to real images and color gamuts. In: Proceedings of the IS & T/SID 7th Color and Imaging Conference. Scottsdale, USA, 1999. 1-8 https://www.researchgate.net/publication/221501975_Lessons_Learned_from_Mondrians_Applied_to_Real_Images_and_Color_Gamuts [6] Schechner Y Y, Narasimhan S G, Nayar S K. Instant dehazing of images using polarization. In: Proceedings of the 2001 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Kauai, HI, USA: IEEE, 2001. I-325-I-332 https://www.researchgate.net/publication/3940554_Instant_dehazing_of_images_using_polarization [7] Kopf J, Neubert B, Chen B, Cohen M, Cohen-Or D, Deussen O, et al. Deep photo: model-based photograph enhancement and viewing. ACM Transactions on Graphics, 2008, 27 (5): Article No. 116 http://d.old.wanfangdata.com.cn/NSTLQK/NSTL_QKJJ0210187593/ [8] Narasimhan S G, Nayar S K. Contrast restoration of weather degraded images. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2003, 25 (6): 713-724 doi: 10.1109/TPAMI.2003.1201821 [9] Narasimhan S G, Nayar S K. Chromatic framework for vision in bad weather. In: Proceedings of the 2000 IEEE Conference on Computer Vision and Pattern Recognition. Hilton Head Island, SC, USA: IEEE, 2000. 598-605 https://www.researchgate.net/publication/3854198_Chromatic_framework_for_vision_in_bad_weather [10] Nayar S K, Narasimhan S G. Vision in bad weather. In: Proceedings of the 7th IEEE International Conference on Computer Vision. Kerkyra, Greece: IEEE, 1999. 820-827 [11] Zhu Q S, Mai J M, Shao L. A fast single image haze removal algorithm using color attenuation prior. IEEE Transactions on Image Processing, 2015, 24 (11): 3522-3533 doi: 10.1109/TIP.2015.2446191 [12] Li Z G, Zheng J H. Edge-preserving decomposition-based single image haze removal. IEEE Transactions on Image Processing, 2015, 24 (12): 5432-5441 doi: 10.1109/TIP.2015.2482903 [13] Caraffa L, Tarel J P. Markov random field model for single image defogging. In: Proceedings of the 2013 IEEE Intelligent Vehicles Symposium (Ⅳ). Gold Coast, QLD, Australia: IEEE, 2013. 994-999 https://www.researchgate.net/publication/261225195_Markov_Random_Field_Model_for_Single_Image_Defogging [14] 刘海波, 杨杰, 吴正平, 张庆年, 邓勇.基于暗通道先验和Retinex理论的快速单幅图像去雾方法.自动化学报, 2015, 41 (7): 1264-1273 http://www.aas.net.cn/CN/abstract/abstract18700.shtmlLiu Hai-Bo, Yang Jie, Wu Zheng-Ping, Zhang Qing-Nian, Deng Yong. A fast single image dehazing method based on dark channel prior and Retinex theory. Acta Automatica Sinica, 2015, 41 (7): 1264-1273 http://www.aas.net.cn/CN/abstract/abstract18700.shtml [15] Chen J, Chau L P. Heavy haze removal in a learning framework. In: Proceedings of the 2015 IEEE International Symposium on Circuits and Systems. Lisbon, Portugal: IEEE, 2015. 1590-1593 [16] Tang K T, Yang J C, Wang J. Investigating haze-relevant features in a learning framework for image dehazing. In: Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus, OH, USA: IEEE, 2014. 2995-3002 https://www.researchgate.net/publication/286594615_Investigating_Haze-Relevant_Features_in_a_Learning_Framework_for_Image_Dehazing [17] Choi L, You J, Bovik A C. Referenceless prediction of perceptual fog density and perceptual image defogging. IEEE Transactions on Image Processing, 2015, 24 (11): 3888-3901 doi: 10.1109/TIP.2015.2456502 [18] Cai B L, Xu X M, Jia K, Qing C M, Tao D C. DehazeNet: an end-to-end system for single image haze removal. IEEE Transactions on Image Processing, 2016, 25 (11): 5187-5198 doi: 10.1109/TIP.2016.2598681 [19] 陈书贞, 任占广, 练秋生.基于改进暗通道和导向滤波的单幅图像去雾算法.自动化学报, 2016, 42 (3): 455-465 http://www.aas.net.cn/CN/abstract/abstract18833.shtmlChen Shu-Zhen, Ren Zhan-Guang, Lian Qiu-Sheng. Single image dehazing algorithm based on improved dark channel prior and guided filter. Acta Automatica Sinica, 2016, 42 (3): 455-465 http://www.aas.net.cn/CN/abstract/abstract18833.shtml [20] He K M, Sun J, Tang X O. Guided image filtering. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2013, 35 (6): 1397-1409 doi: 10.1109/TPAMI.2012.213 [21] Tarel J P, Hautiere N. Fast visibility restoration from a single color or gray level image. In: Proceedings of the 2009 IEEE 12th International Conference on Computer Vision. Kyoto, Japan: IEEE, 2009. 2201-2208 https://www.researchgate.net/publication/221110862_Fast_Visibility_Restoration_from_a_Single_Color_or_Gray_Level_Image [22] Kim J H, Jang W D, Sim J Y, Kim C S. Optimized contrast enhancement for real-time image and video dehazing. Journal of Visual Communication and Image Representation, 2013, 24 (3): 410-425 doi: 10.1016/j.jvcir.2013.02.004 [23] Meng G F, Wang Y, Duan J Y, Xiang S M, Pan C H. Efficient image dehazing with boundary constraint and contextual regularization. In: Proceedings of the 2013 IEEE International Conference on Computer Vision. Sydney, NSW, Australia: IEEE, 2013. 617-624 https://www.researchgate.net/publication/262356211_Efficient_Image_Dehazing_with_Boundary_Constraint_and_Contextual_Regularization [24] Levin A, Lischinski D, Weiss Y. A closed-form solution to natural image matting. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2008, 30 (2): 228-242 doi: 10.1109/TPAMI.2007.1177 [25] Xiao C X, Liu M, Xiao D L, Dong Z, Ma K L. Fast closed-form matting using a hierarchical data structure. IEEE Transactions on Circuits and Systems for Video Technology, 2014, 24 (1): 49-62 doi: 10.1109/TCSVT.2013.2276153 [26] Huang S C, Chen B H, Cheng Y J. An efficient visibility enhancement algorithm for road scenes captured by intelligent transportation systems. IEEE Transactions on Intelligent Transportation Systems, 2014, 15 (5): 2321-2332 doi: 10.1109/TITS.2014.2314696 [27] Li X Y, Gu Y, Hu S M, Martin R R. Mixed-domain edge-aware image manipulation. IEEE Transactions on Image Processing, 2013, 22 (5): 1915-1925 doi: 10.1109/TIP.2013.2237922 [28] Huang S C, Chen B H, Wang W J. Visibility restoration of single hazy images captured in real-world weather conditions. IEEE Transactions on Circuits and Systems for Video Technology, 2014, 24 (10): 1814-1824 doi: 10.1109/TCSVT.2014.2317854 [29] Lai Y H, Chen Y L, Chiou C J, Hsu C T. Single-image dehazing via optimal transmission map under scene priors. IEEE Transactions on Circuits and Systems for Video Technology, 2015, 25 (1): 1-14 doi: 10.1109/TCSVT.2014.2329381 [30] Li Z G, Zheng J H, Zhu Z J, Yao W, Wu S Q. Weighted guided image filtering. IEEE Transactions on Image Processing, 2015, 24 (1): 120-129 doi: 10.1109/TIP.2014.2371234 [31] Curic V, Hendriks C L, BorgeforsG. Salience adaptive structuring elements. IEEE Journal of Selected Topics in Signal Processing, 2012, 6 (7): 809-819 doi: 10.1109/JSTSP.2012.2207371 [32] Wang Z, Bovik A C, Sheikh H R, Simoncelli E P. Image quality assessment: from error visibility to structural similarity. IEEE Transactions on Image Processing, 2004, 13 (4): 600-612 doi: 10.1109/TIP.2003.819861 -

下载:

下载:

下载:

下载: