-

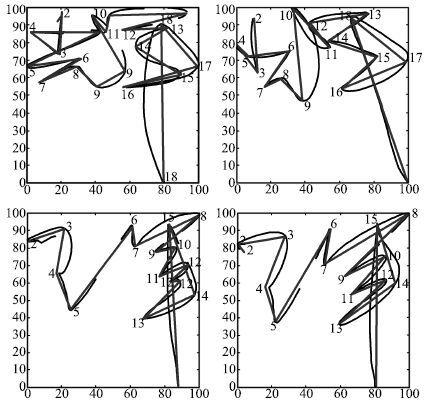

摘要: 针对现有在线笔迹匹配算法鲁棒性不强的问题,本文提出将合并规则和跳跃规则引入到动态规划的迭代过程,以跳跃规则应对书写中的多、漏笔现象,以合并规则应对因多种书写不一致造成的分割点多提取、漏提取现象.在累计差异矩阵计算中,提出以笔画特征,特别是笔画形状信息来度量笔画间的差异.在SVC2004和SUSIG签名数据库上与现有主要在线笔迹匹配算法进行比较.实验结果表明,本文方法能较好应对多种局部书写和分割的不一致,从而获得更准确、鲁棒的笔画对应关系.Abstract: To solve the robustness problem of online handwriting matching, a novel method is proposed in which the jumping and merging rules are introduced to the iterative step of dynamic programming. Specifically, jumping rules are used to deal with the superfluous and loss strokes while merging rules are used to deal with inconsistent handwriting segmentation caused by jerk, hesitating, compound-strokes, etc. In calculation of the cumulative difference matrix, a new measurement is proposed in which stroke shape information is applied to measuring stroke differences. The matching results calculated by the proposed method are compared to those of the existing main methods on SVC2004 and SUSIG public signatures databases. It is shown that the new method can obtain better accuracy and more robust stroke correspondence with respect to various local writings and segmentation inconsistency.

-

表 1 $\beta$ 取值对平均匹配错误率(%)的影响

Table 1 Average matching error rate (%) for various values of $\beta$

β 平均匹配错误率 0.075 9.53 0.10 8.93 0.125 8.23 0.15 7.92 0.175 7.91 0.20 7.96 0.225 8.32 0.25 8.53 表 2 $\eta$ 取值对平均匹配错误率 (%) 的影响

Table 2 Average matching error rate (%) for various values of $\eta$

η 平均匹配错误率 0.05 8.26 0.075 8.07 0.10 7.91 0.125 7.99 0.15 8.03 1.175 8.57 表 3 $\alpha$ 取值对平均匹配错误率(%)的影响

Table 3 Average matching error rate (%) for various values of $\alpha$

α 平均匹配错误率 –0.5 12.13 0 11.26 0.5 10.54 1 9.56 1.5 8.33 2 7.06 2.5 7.31 3 7.91 3.5 8.42 4 8.79 表 4 不同合并规则对匹配错误率 (%) 的影响

Table 4 Average matching error rate (%) for different merging rule combination schemes

组合方案 合并规则序号集合 平均匹配错误率 方案 1 [a] 11.21 方案 2 [a] ~ [c] 8.33 方案 3 [a] ~ [e] 7.12 方案 4 [a] ~ [f ] 6.04 方案 5 [a] ~ [h] 6.52 方案 6 [a] ~ [j] 7.31 表 5 本文笔画差异度量方法与已有方法比较

Table 5 Comparison of the proposed stroke difference measurement method and the existing method

表 6 SVC2004的签名分组表

Table 6 SVC2004 signature group table

组号 签名组序号 1 3, 4, 6, 13, 15, 16, 27, 29, 31, 40 2 2, 5, 9, 11, 12, 14, 17, 18, 28, 30 3 1, 8, 19, 20, 22, 24, 25, 32, 36, 38 4 7, 10, 21, 23, 26, 33, 34, 35, 37, 39 表 7 SUSIG的签名分组表

Table 7 SUSIG signature group table

组号 签名组序号 1 9, 11, 13, 14, 16, 18, 19, 20, 23, 24, 25, 28, 36, 37, 46, 53, 54, 65, 69, 88, 105, 106, 113 2 1, 2, 4, 8, 10, 22, 39, 44, 55, 56, 67, 70, 71, 73, 80, 82, 84, 85, 90, 92, 93, 108, 109, 114 3 3, 21, 26, 38, 40, 53, 59, 61, 64, 66, 74, 76, 77, 83, 86, 89, 91, 94, 97, 99, 100, 101, 103, 111 4 15, 29, 32, 34, 42, 57, 58, 60, 62, 63, 64, 72, 75, 78, 79, 81, 87, 95, 96, 98, 107, 110, 115 表 8 在SVC2004和SUSIG上,本文方法与已有方法在4组笔迹上平均匹配错误率 (%) 比较

Table 8 Average matching error rate (%) comparison on four group signatures between our method and existing methods on SVC2004 and SUSIG

第 1 组 第 2 组 第 3 组 第 4 组 SVC2004 SUSIG SVC2004 SUSIG SVC2004 SUSIG SVC2004 SUSIG Cpalka et al.[30] 8.96 10.17 15.76 16.56 18.85 20.96 23.42 26.85 Barkoula et al.[25] 10.12 11.85 15.73 16.98 19.31 21.21 23.27 26.23 Mohammadi et al.[21] 9.54 10.32 16.53 17.34 20.14 24.44 25.21 29.45 Wang et al.[12] 8.72 9.97 16.23 17.85 20.81 20.64 24.83 23.80 Lee et al.[23] 8.14 9.07 15.13 17.57 19.62 25.17 27.04 28.12 Quan et al.[20] 19.14 20.18 26.31 26.21 31.25 30.47 35.21 34.19 Li et al.[22] 12.34 13.97 20.14 19.39 18.93 25.32 25.31 29.93 Hao et al.[24] 9.31 13.83 17.01 17.63 17.48 20.85 23.18 26.21 本文方法 4.56 5.48 5.14 6.52 5.57 7.41 8.89 10.32 -

[1] Mohammed R A, Nabi R M, Mahmood S M R, Nabi R M. State-of-the-art in handwritten signature verification system. In: Proceedings of the 2015 International Conference on Computational Science and Computational Intelligence. Las Vegas, NV: IEEE, 2015. 519-525 [2] Yu J, Wang Z F. A video, text, and speech-driven realistic 3-D virtual head for human-machine interface. IEEE Transactions on Cybernetics, 2015, 45(5): 991-1002 doi: 10.1109/TCYB.2014.2341737 [3] 李昕, 丁晓青, 彭良瑞. 一种基于微结构特征的多文种文本无关笔迹鉴别方法. 自动化学报, 2009, 35(9): 1199-1208 doi: 10.3724/SP.J.1004.2009.01199Li Xin, Ding Xiao-Qing, Peng Liang-Rui. A microstructure feature based text-independent method of writer identification for multilingual handwritings. Acta Automatica Sinica, 2009, 35(9): 1199-1208 doi: 10.3724/SP.J.1004.2009.01199 [4] 陈晓苏, 吴振华, 肖道举. 一种基于签名分段和HMM的离线中文签名验证方法. 自动化学报, 2007, 32(2): 205-210 http://www.aas.net.cn/CN/abstract/abstract13566.shtmlChen Xiao-Su, Wu Zhen-Hua, Xiao Dao-Ju. Off-line Chinese signature verification based on segmentation and HMM. Acta Automatica Sinica, 2007, 32(2): 205-210 http://www.aas.net.cn/CN/abstract/abstract13566.shtml [5] Liu Y S, Yang Z H, Yang L H. Online signature verification based on DCT and sparse representation. IEEE Transactions on Cybernetics, 2015, 45(11): 2498-2511 doi: 10.1109/TCYB.2014.2375959 [6] Parodi M, Gómez J C. Legendre polynomials based feature extraction for online signature verification. Consistency analysis of feature combinations. Pattern Recognition, 2014, 47(1): 128-140 [7] Nautsch A, Rathgeb C, Busch C. Bridging gaps: an application of feature warping to online signature verification. In: Proceedings of the 2014 International Carnahan Conference on Security Technology (ICCST). Rome, Italy: IEEE, 2014. 1-6 [8] 焦慧敏, 王党校, 张玉茹, 方磊. 基于书写摩擦力的签名识别方法. 自动化学报, 2011, 37(7): 883-890 http://www.aas.net.cn/CN/abstract/abstract17500.shtmlJiao Hui-Min, Wang Dang-Xiao, Zhang Yu-Ru, Fang Lei. Signature verification using handwriting friction force. Acta Automatica Sinica, 2011, 37(7): 883-890 http://www.aas.net.cn/CN/abstract/abstract17500.shtml [9] Pirlo G, Cuccovillo V, Impedovo D, Mignone P. On-line signature verification by multi-domain classification. In: Proceedings of the 14th International Conference on Frontiers in Handwriting Recognition (ICFHR). Heraklion, Greece: IEEE, 2014. 67-72 [10] 王梓合. 练习摹仿笔迹鉴定研究 [硕士学位论文], 西南政法大学, 中国, 2010.Wang Zi-He. Identification of Practicing Imitating Handwriting [Master dissertation], Southwest University of Political Science and Law, China, 2010. [11] Ansari A Q, Kour J. Uniform segmentation in online signature verification. In: Proceedings of the 2015 Annual IEEE India Conference. New Delhi, India: IEEE, 2015. 1-6 [12] Wang K Y, Wang Y H, Zhang Z X. On-line signature verification using segment-to-segment graph matching. In: Proceedings of the 2011 International Conference on Document Analysis and Recognition. Beijing, China: IEEE, 2011. 804 -808 [13] Wirotius M, Ramel J Y, Vincent N. Selection of points for on-line signature comparison. In: Proceedings of the 9th International Workshop on Frontiers in Handwriting Recognition (IWFHR). Tokyo, Japan: IEEE, 2004. 503-508 [14] 蔡洪滨, 施泽生, 范晓峰, 黄浩, 尹社广. 一种基于小波变换提取拐点的手写签名认证方法. 中国图象图形学报, 2003, 8(3): 261- 265 http://www.cnki.com.cn/Article/CJFDTOTAL-ZGTB200303004.htmCai Hong-Bin, Shi Ze-Sheng, Fan Xiao-Feng, Huang Hao, Yin She-Guang. A handwritten signature verification method based on wavelet transform to pick up inflection points. Journal of Image and Graphics, 2003, 8(3): 261-265 http://www.cnki.com.cn/Article/CJFDTOTAL-ZGTB200303004.htm [15] Cpalka K, Zalasiński M, Rutkowski L. A new algorithm for identity verification based on the analysis of a handwritten dynamic signature. Applied Soft Computing, 2016, 43: 47- 56 doi: 10.1016/j.asoc.2016.02.017 [16] Cpalka K, Zalasiński M. On-line signature verification using vertical signature partitioning. Expert Systems with Applications, 2014, 41(9): 4170-4180 doi: 10.1016/j.eswa.2013.12.047 [17] 郭宏, 金先级. 一种基于签名动态特征的特殊点提取算法. 武汉科技大学学报(自然科学版), 2001, 24(2): 186-188 http://www.cnki.com.cn/Article/CJFDTOTAL-YEKJ200102024.htmGuo Hong, Jin Xian-Ji. The extract algorithm of special points in signature based on dynamic information. Journal of Wuhan University of Science and Technology (Natural Science Edition), 2001, 24(2): 186-188 http://www.cnki.com.cn/Article/CJFDTOTAL-YEKJ200102024.htm [18] Brault J J, Plamondon R. Segmenting handwritten signatures at their perceptually important points. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1993, 15(9): 953-957 doi: 10.1109/34.232079 [19] 全中华. 基于动态手写签名的身份认证研究 [博士学位论文], 中国科学技术大学, 中国, 2007.Quan Zhong-Hua. A Study of the Authentication Based on Online Signatures [Ph.D. dissertation], University of Science and Technology of China, China, 2007. [20] Quan Z H, Ji H W. Aligning and segmenting signatures at their crucial points through DTW. In: Proceedings of the 2005 International Conference on Intelligent Computing. Hefei, China: Springer, 2005. 49-58 [21] Mohammadi M H, Faez K. Matching between important points using dynamic time warping for online signature verification [Online], available: http://www.cyberjournals.com/ Papers/Jan2012/01.pdf, June 24, 2016 [22] Li B, Zhang D, Wang K Q. Improved critical point correspondence for on-line signature verification. International Journal of Information Technology, 2006, 12(7): 45-56 http://cn.bing.com/academic/profile?id=179725273&encoded=0&v=paper_preview&mkt=zh-cn [23] Lee J, Yoon H S, Soh J, Chun B T, Chung Y K. Using geometric extrema for segment-to-segment characteristics comparison in online signature verification. Pattern Recognition, 2004, 37(1): 93-103 doi: 10.1016/S0031-3203(03)00229-2 [24] Hao F, Chan C W. Online signature verification using a new extreme points warping technique. Pattern Recognition Letter, 2003, 24(16): 2943-2951 doi: 10.1016/S0167-8655(03)00155-7 [25] Barkoula K, Economou G, Fotopoulos S. Online signature verification based on signatures turning angle representation using longest common subsequence matching. International Journal on Document Analysis and Recognition, 2013, 16(3): 261-272 doi: 10.1007/s10032-012-0193-9 [26] Zhang K, Pratikakis I, Cornelis J, Nyssen E. Using landmarks to establish a point-to-point correspondence between signatures. Pattern Analysis and Applications, 2000, 3(1): 69-75 doi: 10.1007/s100440050007 [27] Ansari A Q, Hanmandlu M, Kour J, Singh A K. Online signature verification using segment-level fuzzy modelling. IET Biometrics, 2014, 3(3): 113-127 doi: 10.1049/iet-bmt.2012.0048 [28] 李彬. 联机手写签名鉴别技术的研究 [博士学位论文], 哈尔滨工业大学, 中国, 2006.Li Bin. Research on the Technology of Online Handwritten Signature Verification. [Ph.D. dissertation], Harbin Institute of Technology, China, 2006. [29] Ibrahim M T, Khan M A, Alimgeer K S, Khan M K, Taj I A, Guan L. Velocity and pressure-based partitions of horizontal and vertical trajectories for on-line signature verification. Pattern Recognition, 2010, 43(8): 2817-2832 doi: 10.1016/j.patcog.2010.02.011 [30] Cpalka K, Zalasiński M, Rutkowski L. New method for the on-line signature verification based on horizontal partitioning. Pattern Recognition, 2014, 47(8): 2652-2661 doi: 10.1016/j.patcog.2014.02.012 [31] Kholmatov A, Yanikoglu B. Identity authentication using improved online signature verification method. Pattern Recognition Letters, 2005, 26(15): 2400-2408 doi: 10.1016/j.patrec.2005.04.017 [32] Kar B, Dutta P K, Basu T K, VielHauer C, Dittmann J. DTW based verification scheme of biometric signatures. In: Proceedings of the 2006 IEEE International Conference on Industrial Technology. Mumbai, India: IEEE, 2006. 381- 386 [33] Yeung D Y, George S, Kashi R, Matsumoto T, Rigoll G. SVC 2004: first international signature verification competition [Online], available: http://www.cse.ust.hk/svc2004, June 24, 2016 [34] Kholmatov A, Yanikoglu B. SUSIG: an on-line signature database, associated protocols and benchmark results. Pattern Analysis and Applications, 2009, 12(3): 227-236 doi: 10.1007/s10044-008-0118-x [35] Sakoe H, Chiba S. Dynamic programming algorithm optimization for spoken word recognition. IEEE Transactions on Acoustics, Speech, and Signal Processing, 1978, 26(1): 43-49 doi: 10.1109/TASSP.1978.1163055 [36] Fischer A, Diaz M, Plamondon R, Ferrer M A. Robust score normalization for DTW-based on-line signature verification. In: Proceedings of the 13th International Conference on Document Analysis and Recognition (ICDAR). Tunis, Italy: IEEE, 2015. 241-245 [37] Fang P, Wu Z C, Meng M, Ge Y J, Yu Y. A novel tablet for on-line handwriting signal capture. In: Proceedings of the 5th World Congress on Intelligent Control and Automation. Hangzhou, China: IEEE, 2004. 3714-3717 -

下载:

下载: